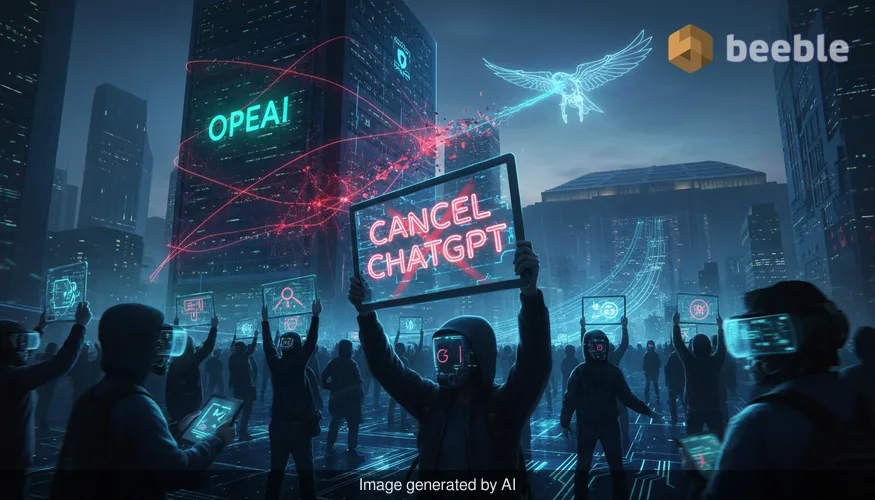

L'ondata 'QuitGPT': perché milioni di persone boicottano OpenAI per i legami con il Pentagono

Il rapporto tra la Silicon Valley e il settore militare è sempre stato un gioco di equilibrio, ma per OpenAI, quella corda potrebbe essersi finalmente spezzata. A partire da marzo 2026, un movimento di base soprannominato “QuitGPT” è passato da un hashtag di nicchia sui social media a un significativo grattacapo commerciale per il laboratorio di IA leader nel mondo. Con oltre 1,5 milioni di utenti che avrebbero cancellato i loro abbonamenti Plus o eliminato i propri account, l’azienda affronta la sua più significativa crisi di pubbliche relazioni dalla breve estromissione di Sam Altman alla fine del 2023.

Al centro della controversia c’è un presunto accordo multimiliardario per integrare i modelli di punta di OpenAI nelle reti classificate del Dipartimento della Difesa degli Stati Uniti. Sebbene OpenAI sostenga che la partnership si concentri sulla logistica e sulla cybersicurezza, la percezione pubblica di “ChatGPT nella sala operativa” ha scatenato una tempesta di dibattiti etici.

Il catalizzatore: dalla ricerca aperta alla difesa classificata

L’attrito è iniziato all’inizio del 2024, quando OpenAI ha rimosso silenziosamente dal suo regolamento d’uso il linguaggio che vietava esplicitamente le applicazioni “militari e belliche”. All’epoca, l’azienda sostenne che il cambiamento era necessario per consentire casi di “duplice uso”, come l’assistenza ai veterani con l’assistenza sanitaria o il miglioramento della logistica militare. Tuttavia, l’accordo del 2026 rappresenta un’integrazione molto più profonda.

Secondo i rapporti che circolano nell’industria tecnologica, il nuovo accordo prevede l’implementazione di versioni specializzate di GPT-5 (e dei suoi successori) all’interno del framework “Joint Warfighting Cloud Capability” (JWCC). Non si tratta solo di scrivere email; si tratta di analizzare enormi quantità di dati di intelligence e assistere nel processo decisionale strategico. Per molti utenti di lunga data che vedevano OpenAI come uno strumento per la creatività democratica, questo spostamento verso il “complesso militare-industriale” sembra un tradimento dello statuto originale dell’azienda.

All’interno del movimento “QuitGPT”

Il movimento, organizzato principalmente attraverso il portale quitgpt.org, sostiene di aver raggiunto una massa critica. Gli organizzatori sostengono che l’IA dovrebbe rimanere una tecnologia neutrale e civile. La loro piattaforma si basa sul principio che la “democratizzazione dell’intelligenza” sia incompatibile con lo sviluppo di strumenti per la violenza sponsorizzata dallo Stato.

“Stiamo assistendo a un cambiamento fondamentale nel sentimento degli utenti”, afferma uno degli organizzatori digitali del movimento. “Le persone si rendono conto che i loro canoni di abbonamento mensili stanno effettivamente sovvenzionando lo sviluppo di tecnologie che alla fine saranno utilizzate nella guerra cinetica. Stanno votando con il portafoglio.”

Oltre agli 1,5 milioni di abbandoni segnalati, il movimento ha guadagnato terreno tra i ricercatori accademici e gli sviluppatori di software che optano sempre più per alternative open source come la serie Llama di Meta o Mistral, citando preoccupazioni su come vengono utilizzati i loro dati e i cicli di feedback.

Il divario etico: sicurezza contro neutralità

La leadership di OpenAI non è rimasta in silenzio. In una recente nota interna, la dirigenza ha sostenuto che fornire all’esercito statunitense l’IA più avanzata è una questione di sicurezza nazionale e di preservazione democratica. Sostengono che se le aziende di IA “occidentali” non collaborano con i rispettivi governi, i regimi autoritari otterranno un vantaggio tecnologico decisivo.

Per comprendere la complessità, si consideri il seguente confronto tra le due filosofie prevalenti oggi nell’industria dell’IA:

| Caratteristica | Il modello dell’“Interesse Nazionale” (OpenAI) | Il modello “Neutrale/Aperto” (QuitGPT/Open-Source) |

|---|---|---|

| Obiettivo primario | Garantire la supremazia tecnologica democratica. | Garantire che l’IA rimanga un’utilità civile globale. |

| Posizione militare | Collaborativa; focus su logistica e difesa. | Rigorosa non partecipazione a contratti militari. |

| Governance dei dati | Centralizzata e conforme alla sicurezza statale. | Decentralizzata o rigorosamente privata/locale. |

| Fonti di finanziamento | VC privati + contratti governativi. | Guidato dalla comunità, accademico o aziendale diversificato. |

Il fattore Anthropic

Ad aggiungere benzina al fuoco è il contrasto percepito con Anthropic. Mentre OpenAI si è avvicinata al Pentagono, Anthropic si è storicamente posizionata come un’azienda “safety-first” (orientata alla sicurezza). Tuttavia, anche Anthropic ha dovuto affrontare critiche per le proprie discussioni con le agenzie di difesa, portando a un più ampio scetticismo verso l’intero ecosistema della “Big AI”. Ciò ha creato un vuoto che i progetti open source si affrettano a colmare, promettendo agli utenti che i loro modelli non saranno mai venduti al miglior offerente militare.

Passaggi pratici per gli utenti preoccupati

Se ti trovi allineato con il movimento “QuitGPT” o sei semplicemente preoccupato per la traiettoria etica dei tuoi strumenti di IA, ci sono diversi passaggi pratici che puoi intraprendere per transizionare il tuo flusso di lavoro:

- Esporta i tuoi dati: Prima di annullare l’abbonamento, utilizza lo strumento di esportazione dati di OpenAI per scaricare la cronologia delle chat. Ciò garantisce di conservare qualsiasi lavoro creativo o codice generato.

- Esplora gli LLM locali: Per chi possiede hardware capace (come i Mac con Apple Silicon o le GPU NVIDIA), eseguire modelli come Llama 3 o Mistral localmente utilizzando strumenti come LM Studio o Ollama garantisce privacy totale e zero legami con corporazioni esterne.

- Verifica l’utilizzo delle tue API: Se sei uno sviluppatore, considera l’implementazione di un “AI Gateway” che ti consenta di passare da un provider all’altro (OpenAI, Anthropic o open-source) con una singola riga di codice. Ciò impedisce il lock-in del fornitore.

- Controlla i termini di servizio: Rivedi periodicamente il “Regolamento d’uso” di qualsiasi strumento di IA che utilizzi. Cerca specificamente clausole riguardanti l’“uso governativo” o la “condivisione dei dati per la sicurezza nazionale”.

Cosa succederà ora?

Il movimento “Cancel ChatGPT” è un test decisivo per l’industria dell’IA. Pone una domanda difficile: un’azienda può essere contemporaneamente un marchio di consumo globale e un primario appaltatore della difesa? Mentre i confini tra software e armamenti continuano a sfumarsi, la scelta per gli utenti non riguarda più solo quale modello sia più intelligente, ma quale azienda si allinei con la propria etica personale.

Resta da vedere se questo boicottaggio costringerà OpenAI a cambiare rotta. Tuttavia, la portata stessa dell’ondata “QuitGPT” suggerisce che l’era della “crescita a tutti i costi” nell’IA potrebbe incontrare la sua prima vera resistenza proprio dalle persone che hanno contribuito a costruirne il successo: gli utenti.

Fonti

- OpenAI Official Blog: Updates on usage policy and military partnerships.

- Department of Defense: Joint Warfighting Cloud Capability (JWCC) announcements.

- QuitGPT.org: Campaign statistics and mission statement.

- TechCrunch: Analysis of AI industry shifts toward defense contracting.

- Reuters: Reports on OpenAI-Pentagon classified network deals.

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito