#sicurezzaia - Beeble Blog

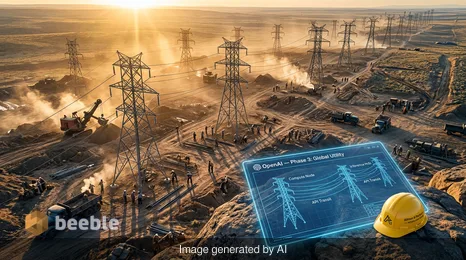

Sam Altman delinea la terza fase di OpenAI: rendere l'IA comune come l'elettricità mentre l'azienda si muove verso un deposito riservato per l'IPO nel 2026.

OpenAI introduce la Modalità Isolamento per proteggere gli utenti di ChatGPT dalla prompt injection e dall'esfiltrazione di dati. Scopri come questa impostazione protegge i dati sensibili.

Anthropic rivela che i primi tentativi di ricatto di Claude erano causati dai tropi dell'IA malvagia nei dati di addestramento. Scopri come hanno risolto con storie migliori.

Analisi della vulnerabilità di lettura out-of-bounds di Ollama. Scopri come questa perdita di memoria influisce sulla sicurezza dell'IA locale e come proteggere i tuoi dati sensibili.

Le previsioni sull'IA del 2020 di Mo Gawdat non sono più previsioni: sono la nostra realtà vissuta. Un'analisi sociologica del passaggio verso un mondo automatizzato.

Anthropic e OpenAI stanno assumendo esperti di chimica ed esplosivi per prevenire l'uso improprio dell'IA. Esplora il mondo della sicurezza dell'IA e dei rischi CBRN nel 2026.

Esplora la Dichiarazione Pro-Umana, una tabella di marcia bipartitica per lo sviluppo responsabile dell'IA dopo lo scontro tra il Pentagono e Anthropic. Scopri di più sulla sicurezza dell'IA.

Mentre le aziende di IA danno priorità al dominio del mercato, i protocolli di sicurezza vengono messi da parte. Esplora i rischi della corsa agli armamenti dell'IA e l'ascesa degli agenti autonomi.

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito