L'illusione della neutralità: perché la protesta contro Google Gemini è una lotta per l'anima umana del software

Il moderno panorama tecnologico promette un futuro di connettività senza soluzione di continuità, in cui l'intelligenza artificiale funge da compagno digitale, alleggerendo i nostri carichi cognitivi e intrecciando i fili frammentati della nostra routine quotidiana in un arazzo coerente e ottimizzato di progresso umano. Ci viene detto che questi sistemi sono gli strumenti definitivi per la democratizzazione, capaci di risolvere il cambiamento climatico, curare malattie e favorire una comunità globale attraverso il puro potere della sintesi generativa. Tuttavia, questa visione rimane una fragile illusione a meno che non si affronti la realtà che questi stessi strumenti sono algoritmicamente legati alle priorità di chi li finanzia, portando inevitabilmente a una perdita di autonomia quando il codice "neutrale" viene riutilizzato per scopi letali sotto le spoglie della sicurezza nazionale. Mentre ci addentriamo nel 2026, l'attrito tra la promessa del silicio e la realtà d'acciaio della guerra ha raggiunto un punto di rottura, cristallizzato in una lettera aperta di oltre 600 dipendenti di Google al CEO Sundar Pichai.

Seduto in un caffè affollato martedì scorso, ho osservato un giovane — probabilmente uno sviluppatore, a giudicare dal laptop pieno di adesivi — intento a perfezionare un prompt per un LLM. Stava progettando una catena logistica più efficiente per una piccola impresa. Per lui, il codice era un'utilità banale, un'ancora che manteneva la sua vita professionale radicata in mezzo al caos sistemico. Ma allargando lo sguardo a un livello macro, la stessa architettura che usa per aiutare un fioraio locale potrebbe, con pochi spostamenti di parametri in un contesto riservato, diventare la spina dorsale di un sistema di identificazione dei bersagli. Questa è l'ansia viscerale che ha permeato i corridoi delle divisioni Google DeepMind e Cloud. La lettera non è solo una protesta; è un profondo rifiuto dell'atomizzazione che permette a un lavoratore di essere separato dalle conseguenze ultime del proprio lavoro.

Il campo di battaglia linguistico: 'Disumano' vs. 'Legale'

Linguisticamente parlando, il conflitto tra il personale di Google e il Pentagono è una guerra di definizioni. Quando i dipendenti usano la parola "disumano" per descrivere le potenziali applicazioni militari di Gemini, stanno intraprendendo un tipo specifico di analisi del discorso. Non stanno semplicemente usando un aggettivo moraleggiante; stanno tentando di definire un confine per ciò che costituisce la tecnologia "umana". Al contrario, la spinta del Pentagono per la frase "tutti gli usi legali" è un classico esempio di come il linguaggio possa essere usato come anestetico culturale. "Legale" è un termine sistemico, che muta con i venti politici e fornisce uno scudo opaco contro il controllo pubblico. Se la legge consente la sorveglianza di massa o il puntamento autonomo, allora il comportamento è, per definizione, legale, indipendentemente dal suo impatto viscerale sui civili.

Storicamente, questo tiro alla fune semantico è profondamente radicato nell'evoluzione del complesso militare-industriale-digitale. Il linguaggio qui funge da sito archeologico, dove ogni nuova clausola contrattuale rivela strati di dinamiche di potere in continua evoluzione. Insistendo sulla "flessibilità operativa", il Dipartimento della Difesa cerca di trasformare il potenziale multiforme di Gemini in uno strumento unico e letale. I dipendenti, molti dei quali sono esperti in filologia e informatica, riconoscono che una volta ampliato il linguaggio di un contratto, la capacità di imporre tutele etiche diventa effimera. Paradossalmente, più il linguaggio è "flessibile", più le applicazioni dannose diventano rigide e ineludibili.

L'arcipelago della forza lavoro moderna

Culturalmente parlando, spesso vediamo le grandi aziende tecnologiche come monoliti, ma sono più simili a una società come arcipelago — migliaia di individui che vivono in un ecosistema digitale densamente popolato, eppure spesso si sentono completamente atomizzati rispetto ai centri decisionali delle loro "isole". Questa protesta è un momento raro in cui le singole isole hanno colmato il divario per formare una voce collettiva. Il fatto che più di 20 direttori e vicepresidenti abbiano firmato questa lettera è sintomatico di un profondo cambiamento strutturale nel modo in cui i lavoratori tecnologici vedono il proprio habitus. Non sono più disposti a essere ingranaggi passivi di una macchina; stanno rivendicando il loro diritto di plasmare la traiettoria etica delle loro creazioni.

Questa azione collettiva mi ricorda una conversazione avuta con un ricercatore senior anonimo che ha trascorso un decennio nell'IA. Ha descritto la sensazione di "ferita morale" — un termine solitamente riservato ai soldati — nel rendersi conto che il suo lavoro sul riconoscimento delle immagini veniva adattato per la guerra con i droni. A livello individuale, il ricercatore ha provato un profondo senso di tradimento. L'atto banale di addestrare un modello a riconoscere un "pedone" portava improvvisamente il peso di una decisione di vita o di morte. Attraverso questa lente, la protesta non riguarda solo un contratto; è un meccanismo di adattamento per professionisti che cercano di conciliare la propria etica personale con le pressioni sistemiche di un accordo di difesa multimiliardario.

Dal Progetto Maven al paradosso di Gemini

Dietro le quinte di questa tendenza c'è il ricordo ossessionante del 2018. La lettera fa esplicito riferimento al Progetto Maven, il precedente tentativo di integrare l'IA di Google nel programma di droni del Pentagono. Quella rivolta di successo portò alla creazione dei Principi per l'IA di Google, un documento inteso a fungere da bussola morale. Tuttavia, nel contesto della modernità liquida — un concetto introdotto da Zygmunt Bauman per descrivere il nostro attuale stato di costante cambiamento e incertezza — anche i principi più robusti possono sembrare transitori. De facto, ciò che era considerato una "linea rossa" nel 2018 viene ora negoziato nel 2026 mentre l'"economia dell'attenzione" sposta il suo focus verso la sicurezza nazionale come nuova frontiera del profitto.

Curiosamente, l'emergere di Anthropic come contrappunto a Google aggiunge un nuovo livello a questa narrazione. Quando il CEO Dario Amodei ha rifiutato la richiesta del Pentagono di accesso illimitato, ha infranto il mito secondo cui la cooperazione totale sia inevitabile. La sua dichiarazione secondo cui l'IA può "minare, piuttosto che difendere, i valori democratici" in certi casi è un'ammissione sfumata della fragilità intrinseca della tecnologia. Di conseguenza, il successivo divieto degli strumenti di Anthropic da parte dell'attuale amministrazione evidenzia l'alta posta in gioco di questa posizione etica. In altre parole, la "dieta digitale da fast-food" fatta di facili contratti governativi viene rifiutata da alcuni a favore di una posizione etica più densa nutrizionalmente, sebbene finanziariamente più rischiosa.

La sala degli specchi: sorveglianza e perdita delle libertà civili

Una delle paure più sentite espresse nella lettera è l'uso di Gemini per la sorveglianza di massa e la profilazione individuale. Da un punto di vista societario, viviamo sempre più in una sala degli specchi, dove le nostre impronte digitali ci vengono riflesse attraverso algoritmi che prevedono — e talvolta dettano — il nostro comportamento. In termini quotidiani, questo si manifesta come annunci personalizzati o feed di social media. Ma quando questi stessi strumenti vengono applicati a "carichi di lavoro classificati", gli specchi diventano vetri unidirezionali. La mancanza di trasparenza significa che non c'è modo di garantire che civili innocenti non vengano profilati sulla base di punti dati frammentati.

In sostanza, i dipendenti avvertono contro la creazione di uno stato di sorveglianza onnipresente alimentato proprio dagli strumenti che hanno costruito per aiutare le persone a trovare informazioni. L'ironia non sfugge loro. Questo è il paradosso della città moderna: mettiamo in scena le nostre identità sociali mutevoli in spazi digitali pubblici e privati, ignari del fatto che il palcoscenico stesso potrebbe registrare ogni nostro movimento per uno scopo "autonomo letale". Il "mosaico" delle nostre vite — i nostri dati sulla posizione, la nostra cronologia delle ricerche, le nostre comunicazioni private — viene ricucito insieme in un profilo bersaglio senza il nostro consenso o conoscenza.

Rivendicare la narrazione umana

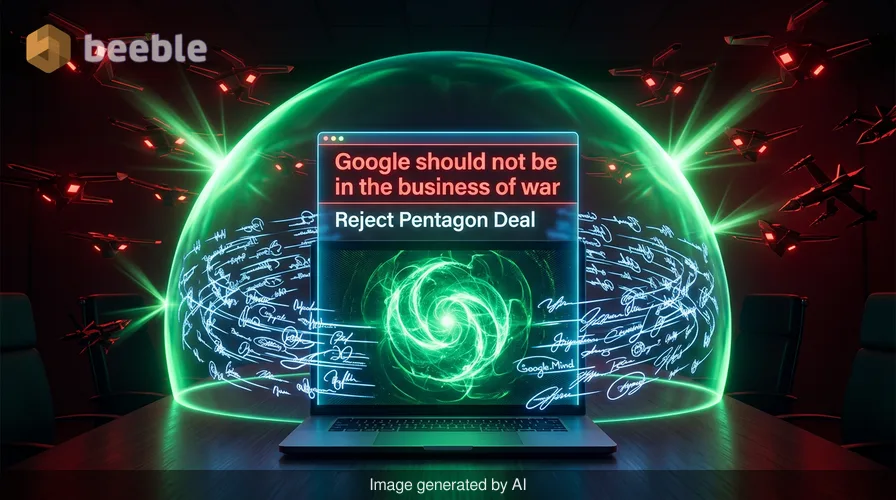

In definitiva, la protesta dei dipendenti di Google è un tentativo di rivendicare la narrazione umana in un mondo sempre più automatizzato. Sostengono che Google non dovrebbe essere "nel business della guerra", un sentimento che sembra sia nostalgico che radicale nell'attuale clima geopolitico. La nostalgia, in questo caso, funge da anestetico culturale contro l'ansia di un futuro incerto; richiama un'era in cui il mantra "Don't be evil" sembrava una promessa genuina piuttosto che un cimelio del marketing.

Allargando lo sguardo, questa storia riguarda molto più di una singola azienda o di un singolo contratto. Riguarda la tensione sistemica tra il ritmo rapido dell'innovazione tecnologica e il lavoro lento e deliberato dell'etica umana. Ci chiede di considerare se siamo disposti ad accettare un mondo in cui i nostri strumenti più avanzati vengono utilizzati per erodere le stesse libertà civili che avrebbero dovuto migliorare. Dietro le quinte, i negoziatori del Pentagono e i dirigenti di Google stanno soppesando la flessibilità operativa rispetto ai diritti umani. Ma sul campo, i lavoratori ci ricordano che il codice non è mai solo codice — è un riflesso dei nostri valori collettivi.

Spunti di riflessione

Mentre navighiamo in questa complessa intersezione tra tecnologia e moralità, potremmo considerare le seguenti riflessioni per la nostra vita digitale:

- Quanto spesso consideriamo l'"archeologia" delle app che usiamo? Chi le ha finanziate e quali erano le intenzioni originali dietro il loro sviluppo?

- Nella nostra vita professionale, dove tracciamo le nostre "linee rosse"? Siamo consapevoli di come i nostri compiti banali potrebbero contribuire a sistemi più ampi e potenzialmente dannosi?

- Possiamo rivendicare un senso di autonomia nell'"economia dell'attenzione" chiedendo maggiore trasparenza alle piattaforme che detengono i nostri dati più personali?

- Se consideriamo le nostre interazioni digitali come un "mosaico" della nostra identità, chi vogliamo che sia a tenere l'ago in mano?

Mentre chiudi questa scheda e torni alla tua routine quotidiana, prenditi forse un momento per osservare l'onnipresenza dell'IA intorno a te. Metti in discussione la norma profondamente radicata secondo cui il progresso tecnologico debba sempre avvenire a scapito della chiarezza etica. A volte, l'atto di progresso più profondo è il coraggio di dire "no".

Fonti:

- Bauman, Z. (2000). Liquid Modernity. Cambridge: Polity Press.

- Google AI Principles (Documento interno ufficiale, aggiornato al 2025).

- Lettera aperta dei dipendenti di Google a Sundar Pichai (Aprile 2026).

- Dichiarazione di Dario Amodei, CEO di Anthropic, riguardo ai negoziati con il Dipartimento della Difesa (Marzo 2026).

- U.S. Department of Defense, Directive 3000.09: Autonomy in Weapon Systems (Revisionato nel 2024).

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito