La battaglia per la fonte della verità: perché l'Enciclopedia Britannica ha citato in giudizio OpenAI

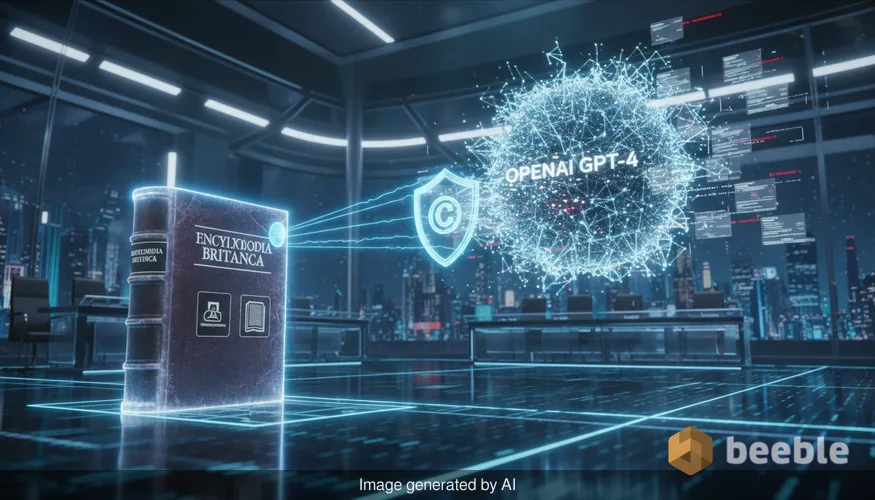

La tempesta legale che circonda l'IA generativa ha raggiunto un nuovo picco. L'Enciclopedia Britannica e la sua controllata, Merriam-Webster, hanno ufficialmente intentato una causa contro OpenAI, sostenendo che i modelli del gigante dell'IA non si siano limitati ad apprendere dai loro vasti depositi di conoscenza, ma li abbiano effettivamente "memorizzati".

Questa causa, depositata presso il tribunale federale in seguito alle segnalazioni di Reuters, segna una significativa escalation nella tensione in corso tra gli editori tradizionali e gli architetti dei modelli linguistici di grandi dimensioni (LLM). Mentre le precedenti cause di autori e organizzazioni giornalistiche si concentravano sull'atto dell'addestramento, il caso della Britannica evidenzia un fenomeno più tecnico e forse più dannoso: il rigurgito quasi testuale di fatti e definizioni proprietarie.

Il cuore del conflitto: memorizzazione vs. apprendimento

Al centro della denuncia c'è la distinzione tra un'IA che "comprende" un concetto e una che memorizza semplicemente una copia del testo. Britannica sostiene che GPT-4 può produrre su richiesta copie quasi identiche dei suoi articoli protetti da copyright. Per un'azienda che ha trascorso oltre 250 anni a curare la conoscenza umana, questa non è solo una violazione del copyright: è una minaccia diretta al proprio modello di business.

Per comprendere la gravità di ciò, si consideri l'analogia tra uno studente e un libro di testo. Se uno studente legge un libro di storia e poi scrive un saggio originale basato su ciò che ha imparato, ciò è generalmente considerato un uso trasformativo. Tuttavia, se quello studente si presenta a un esame e recita il libro di testo parola per parola, non sta più dimostrando comprensione; sta agendo come una fotocopiatrice umana. Britannica sostiene che i modelli di OpenAI stiano facendo quest'ultimo.

Le prove del “rigurgito”

La causa fornisce esempi specifici in cui GPT-4 avrebbe prodotto risposte "sostanzialmente simili" alle voci della Britannica. Nel mondo degli LLM, questo è noto come "rigurgito". Si verifica quando un modello viene addestrato così intensamente su uno specifico set di dati che i pesi della rete neurale vengono sintonizzati per riprodurre esattamente quei dati quando sollecitati con parole chiave specifiche.

Per Merriam-Webster, la posta in gioco è altrettanto alta. Le definizioni del dizionario sono, per necessità, concise e specifiche. Se un'IA fornisce una definizione che corrisponde alle sfumature strutturali e al fraseggio unico di Merriam-Webster, elimina la necessità per un utente di visitare il sito web dell'editore. Questa realtà "zero-click" prosciuga le entrate pubblicitarie e il potenziale di abbonamento proprio di quelle istituzioni che forniscono i dati di alta qualità su cui l'IA fa affidamento.

Perché questa causa è diversa

Abbiamo visto casi simili da parte del The New York Times e di vari romanzieri famosi, ma il caso Britannica è unico per due ragioni:

- La natura dei dati: A differenza di un romanzo, che è protetto dall'espressione creativa, un'enciclopedia è una raccolta di fatti. Sebbene i fatti in sé non possano essere protetti da copyright, la selezione e la disposizione di tali fatti possono esserlo. Britannica sostiene che OpenAI abbia cooptato la struttura specifica e la sintesi che rendono autorevoli le loro voci.

- Il problema della "Fonte della Verità": OpenAI posiziona ChatGPT come un assistente che fornisce informazioni fattuali. Se tali informazioni provengono direttamente dalla Britannica senza attribuzione o compenso, OpenAI sta essenzialmente vendendo la reputazione di accuratezza della Britannica come proprio prodotto.

La probabile difesa di OpenAI: Fair Use e trasformazione

Sebbene OpenAI non abbia ancora rilasciato una confutazione completa a questo specifico deposito, la loro difesa storica rimane coerente. Sostengono che l'addestramento dei modelli di IA su dati internet pubblicamente disponibili costituisca "fair use". Affermano che i modelli stiano creando qualcosa di completamente nuovo — un motore di ragionamento multiuso — piuttosto che un database di opere esistenti.

OpenAI indica spesso anche le "misure di sicurezza" implementate per prevenire l'esatto tipo di rigurgito di cui si lamenta Britannica. Tuttavia, come suggerisce questa causa, tali barriere potrebbero essere più porose di quanto l'azienda ammetta, specialmente quando gli utenti impiegano specifiche tecniche di prompting per "estrarre" i dati di addestramento.

La sfida tecnica del "disimparare"

Uno degli aspetti più difficili di questa battaglia legale è la realtà tecnica degli LLM. Una volta che un modello è addestrato su un set di dati, "disimparare" quei dati specifici è notoriamente difficile. Non è semplice come eliminare un file da un disco rigido. L'informazione è diffusa su miliardi di parametri.

Se il tribunale dovesse pronunciarsi a favore della Britannica, OpenAI potrebbe essere costretta a fare di più che pagare una multa. Potrebbe essere obbligata a filtrare i risultati in modo più aggressivo o, nel peggiore dei casi per l'azienda tecnologica, a riaddestrare i modelli da zero senza i dati contestati — un processo che costerebbe milioni di dollari e mesi di tempo di calcolo.

Cosa significa per il futuro dell'IA

Questa causa è un indicatore per l'era della "licenza dei dati" dell'IA. Ci stiamo allontanando dal periodo del "Far West" in cui le aziende di IA raschiavano il web impunemente. Nei prossimi mesi, vedremo probabilmente altre partnership di alto profilo in cui le aziende di IA pagheranno per l'accesso a silos di dati verificati e di alta qualità.

Per gli utenti, ciò potrebbe significare che le risposte dell'IA diventeranno più trasparenti, con citazioni più chiare e link alle fonti originali. Per l'industria, significa che il costo per costruire un LLM di alto livello sta per aumentare significativamente, poiché le fonti di dati "gratuite" iniziano a porre barriere legali a pagamento.

Consigli pratici per aziende e creatori

Mentre il panorama legale cambia, ecco come dovresti navigare in questo ambiente in evoluzione:

- Verifica i risultati dell'IA: Se usi l'IA per ricerche fattuali, confronta le informazioni con le fonti primarie. Il problema della "memorizzazione" dimostra che l'IA può talvolta presentare materiale protetto da copyright come proprio pensiero originale.

- Rispetta le licenze: Se stai costruendo strumenti utilizzando le API degli LLM, tieni presente che lo stato legale dei dati di addestramento è ancora in divenire. Assicurati che i tuoi casi d'uso non facilitino inavvertitamente la violazione del copyright.

- Osserva il precedente: L'esito del caso Britannica vs. OpenAI stabilirà probabilmente lo standard per il trattamento dei contenuti "fattuali" nell'era dell'IA. Una vittoria per Britannica potrebbe portare a un ecosistema dell'informazione più frammentato e basato sul pagamento.

Fonti

- Reuters: Encyclopedia Britannica and Merriam-Webster sue OpenAI over copyright

- U.S. Copyright Office: Artificial Intelligence and Copyright Public Inquiries

- OpenAI Blog: Our approach to data and privacy in the age of AI

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito