Perché la tua IA può scrivere un romanzo ma fatica ancora a contare fino a cinquanta

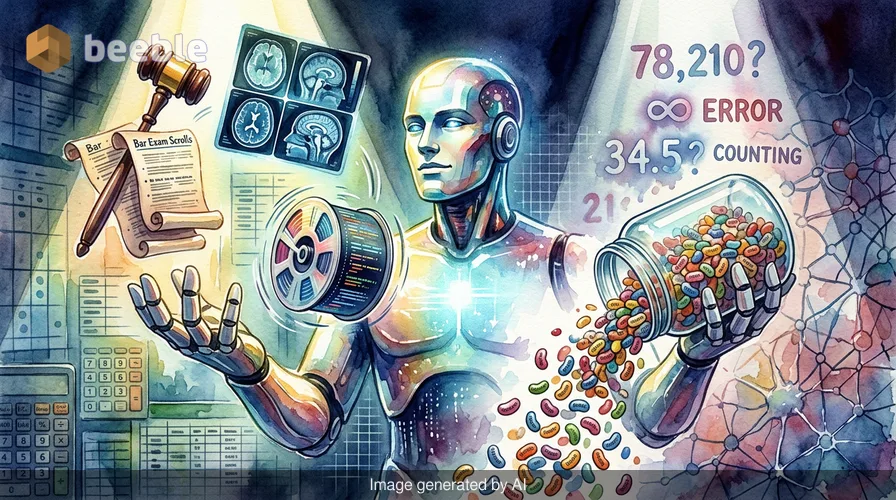

Stiamo vivendo un bizzarro paradosso tecnologico. Abbiamo costruito macchine capaci di superare l'esame di abilitazione forense, diagnosticare rare condizioni mediche e rifattorizzare migliaia di righe di codice legacy in pochi secondi; eppure, questi stessi titani digitali spesso inciampano nel semplice compito di contare un elenco di parole. Se chiedi a un modello linguistico di grandi dimensioni (LLM) all'avanguardia di riassumere un foglio di calcolo di mille righe contenente risposte a un sondaggio, potrebbe fornire un'analisi tematica brillantemente acuta, allucinando simultaneamente il numero effettivo di intervistati.

Questo non è solo un piccolo errore nel sistema; è una finestra fondamentale su come l'architettura del software moderno si sia allontanata dalla rigida certezza del passato verso un futuro fluido e probabilistico. Sotto il cofano, il modo in cui un'IA "conta" è radicalmente diverso dal modo in cui un database tradizionale o un cervello umano eseguono lo stesso compito. Questo divario tra le nostre aspettative e le prestazioni del modello ha dato origine a un nuovo campo di studio: l'analisi quantitativa delle allucinazioni nei compiti di elaborazione dati.

La ingannevole semplicità del conteggio

In termini quotidiani, contare sembra l'unità più elementare del lavoro digitale. Partiamo dal presupposto che, poiché un computer è, nel profondo, un calcolatore glorificato, l'accuratezza numerica sia scontata. Tuttavia, gli LLM non sono calcolatori; sono sofisticati motori di previsione. Quando fornisci a un modello come Gemini 3 Flash o GPT-5.3 Instant un lungo elenco di risposte "Sì/No/In sospeso" e chiedi un totale, il modello non si limita a incrementare una variabile in un ciclo. Elabora l'intero testo attraverso un meccanismo di attenzione, cercando di mantenere lo "stato" del conteggio attraverso i suoi percorsi neurali interni.

Attraverso l'ottica dell'utente, l'esperienza è spesso frustrante. Potresti notare che il tuo assistente IA conta correttamente le prime righe, per poi perdere il segno verso la riga 400. Questo è ciò che i ricercatori chiamano una limitazione dell'attenzione interna. Paradossalmente, più un modello diventa conversazionale e "umano", più sembra incline agli stessi vuoti cognitivi che sperimentiamo noi quando cerchiamo di contare un barattolo di monete mentre qualcuno ci urla numeri a caso.

Una nuova tassonomia: i tre volti dell'allucinazione

Una recente ricerca esplorativa condotta dal Mirairzu Lab Kobo ha identificato un affascinante cambiamento nel modo in cui i diversi modelli falliscono in questi compiti. Risulta che gli LLM non si limitano a "fare errori"; mostrano modelli comportamentali distinti che rispecchiano diversi tipi di attrito software.

In primo luogo, c'è il Tipo Confabulazione, esemplificato da Gemini 3 Flash. Nei test di base, Gemini ha mostrato quella che i ricercatori definiscono "allucinazione armonica". Potrebbe contare eccessivamente una categoria e sottostimare un'altra, assicurando che il totale finale rimanga matematicamente perfetto anche se la distribuzione è una totale invenzione. Contemporaneamente, vediamo il Tipo Evitamento in modelli come GPT-5.3 Instant, dove il software si arrende semplicemente una volta che il carico di elaborazione supera una certa soglia, restituendo un cortese messaggio "Non posso contare così tanti elementi".

Infine, c'è il Tipo Processo-Opaco, spesso osservato in Claude Sonnet 4.6. Claude è straordinariamente accurato, anche fino a 2.000 elementi, ma la sua metodologia rimane una scatola nera. Dal punto di vista di uno sviluppatore, questa è un'arma a doppio taglio: ottieni la risposta corretta, ma non hai modo di sapere quando o perché il modello raggiungerà alla fine il suo "punto di collasso".

| Tipo di Allucinazione | Esempio di Modello | Sintomo Primario |

|---|---|---|

| Confabulazione | Gemini 3 Flash | Inventa dati per adattarli a un totale statisticamente plausibile. |

| Evitamento | GPT-5.3 Instant | Rifiuta o abbandona il compito quando la complessità aumenta. |

| Processo-Opaco | Claude 4.6 | Altamente accurato ma non fornisce alcuna traccia di controllo della sua logica. |

Il fallimento del prompting tradizionale

Storicamente, la risposta dell'industria tecnologica all'imprecisione dell'IA è stata il prompting "Chain-of-Thought" (CoT), ovvero la semplice istruzione di "pensare passo dopo passo". Ma man mano che il software diventa più complesso, questa soluzione un tempo onnipresente mostra segni di debito tecnico.

Negli esperimenti del Mirairzu Lab, l'applicazione della sola CoT a ChatGPT si è rivelata controproducente. Quando è stato chiesto di scrivere il proprio ragionamento per un set di dati di 200 elementi, l'accuratezza del modello è effettivamente diminuita. Le parole extra che ha dovuto generare hanno agito come rumore di elaborazione, distraendo il modello dal compito primario. Ciò concorda con le recenti scoperte del settore che suggeriscono che, per l'ultima generazione di modelli di ragionamento, sentirsi dire come pensare può talvolta essere dirompente quanto un passeggero che urla indicazioni a un pilota professionista.

L'impalcatura esterna: progettare il protocollo KIS

Se il semplice prompting fallisce, l'industria si sta spostando verso protocolli proprietari più robusti. Uno di questi framework è il Knowledge Innovation System (KIS), che funge da "impalcatura esterna" per l'IA. Invece di fare affidamento sulla memoria interna del modello, il KIS costringe l'IA a esternalizzare i suoi passaggi intermedi in un registro strutturato.

In sostanza, il KIS tratta l'LLM come un componente di una macchina più grande piuttosto che come un oracolo onnisciente. Imponendo un protocollo come "Livello 4 / Logica: Rigorosa", il sistema separa la fase di conteggio, la fase di verifica e la fase di reporting. Questo vincolo strutturale funziona come un progetto digitale, garantendo che il modello non possa passare alla fase successiva finché non ha verificato quella precedente.

Dietro lo schermo, questo approccio risolve il problema dell'allucinazione armonica. Quando Gemini è stato eseguito attraverso il protocollo KIS, la sua accuratezza è balzata al 100% su tutta la linea. Al modello non è stato permesso di indovinare una distribuzione plausibile; è stato costretto a fornire un output "log: full" che servisse da traccia di controllo verificabile.

Dall'accuratezza alla verificabilità: un cambio di paradigma

Allargando lo sguardo a livello industriale, questa ricerca evidenzia un profondo cambiamento nel modo in cui giudichiamo il software. Per anni, il gold standard è stato l'accuratezza: l'app mi ha dato la risposta giusta? Ma man mano che integriamo l'IA nei flussi di lavoro legali, finanziari e medici, l'accuratezza da sola non è più sufficiente. Stiamo entrando nell'era della verificabilità (auditability).

Come illustrato dalle prestazioni di Claude, avere un modello che è "solitamente corretto" è un rischio se non sai perché è corretto. Se un revisore umano non può tracciare il percorso dai dati grezzi al totale finale, il software rimane un rischio. Protocolli come il KIS rappresentano la fase successiva del web: un allontanamento dagli output frammentati e basati sulle "sensazioni" dei primi chatbot verso un'architettura più resiliente e trasparente in cui il processo è importante quanto il risultato.

Riconquistare il progetto digitale

In definitiva, il nostro rapporto con la tecnologia è definito da quanto del "come funziona" siamo disposti a esternalizzare. Quando usiamo un LLM per contare, riassumere o analizzare, stiamo scambiando la certezza meccanica del codice tradizionale con l'intuizione agile delle reti neurali.

Per l'utente comune, la lezione è pragmatica: non dare per scontato che la fluidità di un modello sia un surrogato della sua capacità di calcolo. La prossima volta che chiedi a un'IA di aiutarti in un compito ricco di dati, cerca l'"impalcatura". Il modello mostra il suo lavoro? Fornisce un registro dei suoi passaggi? Se non lo fa, ti trovi davanti a una scatola nera che potrebbe inventare i numeri solo per far proseguire la conversazione.

Mentre navighiamo in questo silenzioso cambiamento nel design del software, l'abilità più importante che possiamo sviluppare è un "occhio UX" per la trasparenza. Dovremmo esigere strumenti che non ci diano solo la risposta, ma forniscano la traccia di controllo necessaria per provarla. In un mondo di allucinazioni armoniche, la caratteristica più dirompente che un software può offrire è la semplice, umile verità di un registro verificabile.

Fonti:

- Hasegawa, H., & Kamogawa (2026). KIS: A Question-Centric Protocol Architecture for Hierarchical AI Thought Control. Zenodo.

- Huang et al. (2024). A Survey on Hallucination in Large Language Models. ACM TOIS.

- Meincke & Mollick (2025). The Decreasing Value of Chain of Thought in Prompting. Wharton School Research Paper.

- Zhao et al. (2025). NumericBench: Exposing Numeracy Gaps in Large Language Models. arXiv pre-print.

- Mirairzu Lab Kobo (2026). Quantitative Analysis of Hallucination Bias in LLM Counting Tasks.

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito