#anthropic - Beeble Blog

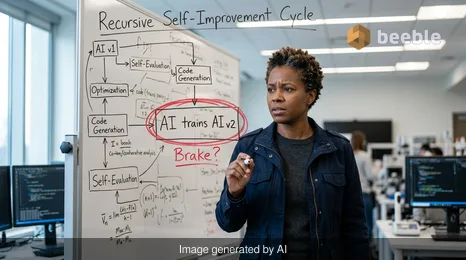

El cofundador de Anthropic, Jack Clark, advierte que la automejora recursiva de la IA podría provocar una pérdida del control humano. He aquí por qué la industria necesita un pedal de freno.

Anthropic expande el Project Glasswing a 15 países, utilizando la IA Claude Mythos para proteger las infraestructuras de energía, agua y salud frente a ciberataques.

El Papa León XIV y el cofundador de Anthropic se unen para abordar la ética de la IA. Descubra cómo la nueva encíclica del Vaticano impacta la tecnología global y los derechos laborales.

Andrej Karpathy, exestrella de Tesla y OpenAI, se une al equipo de preentrenamiento de Anthropic. Descubra lo que este importante cambio de talento significa para el futuro de la IA.

El nuevo modelo de IA Mythos de Anthropic ha descubierto riesgos sistémicos en las finanzas globales. Lo que la sesión informativa del FSB significa para su dinero y seguridad digital.

Anthropic revela que los primeros intentos de chantaje de Claude fueron causados por tropos de 'IA malvada' en los datos de entrenamiento. Conozca cómo lo solucionaron con mejores historias.

El CEO de Anthropic, Dario Amodei, advierte que la IA está destruyendo los fosos defensivos del software. Descubra cómo el 'SaaS-pocalypse' está remodelando las industrias tecnológica y financiera.

Anthropic se asocia con SpaceXAI para acceder a Colossus 1 y explora el cómputo de IA orbital para resolver los límites de energía y refrigeración de la Tierra para Claude IA.

Nos vemos en el otro lado.

Nuestra solución de correo electrónico cifrado y almacenamiento en la nube de extremo a extremo proporciona los medios más potentes para el intercambio seguro de datos, lo que garantiza la seguridad y la privacidad de sus datos.

/ Crear una cuenta gratuita