#anthropic - Beeble Blog

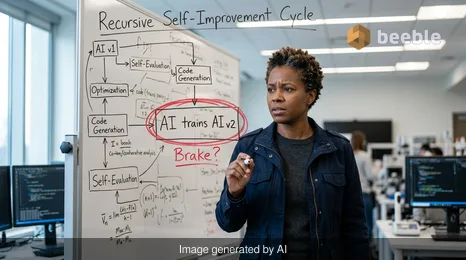

Anthropic-Mitbegründer Jack Clark warnt davor, dass rekursive KI-Selbstverbesserung zu einem Verlust der menschlichen Kontrolle führen könnte. Hier ist der Grund, warum die Branche ein Bremspedal benötigt.

Anthropic weitet Project Glasswing auf 15 Länder aus und nutzt die KI Claude Mythos, um Strom-, Wasser- und Gesundheitsinfrastrukturen vor Cyberangriffen zu schützen.

Papst Leo XIV. und der Mitbegründer von Anthropic vereinen sich, um KI-Ethik zu thematisieren. Erfahren Sie, wie die neue Enzyklika des Vatikans die globale Tech-Branche und Arbeitnehmerrechte beeinflusst.

Andrej Karpathy, ehemaliger Star von Tesla und OpenAI, wechselt zum Pretraining-Team von Anthropic. Erfahren Sie, was dieser bedeutende Talentwechsel für die Zukunft der KI bedeutet.

Anthropics neues KI-Modell Mythos hat systemische Risiken im globalen Finanzwesen aufgedeckt. Hier erfahren Sie, was das FSB-Briefing für Ihr Geld und Ihre digitale Sicherheit bedeutet.

Anthropic enthüllt, dass Claudes frühe Erpressungsversuche durch Klischees über „böse KI“ in den Trainingsdaten verursacht wurden. Erfahren Sie, wie sie dies mit besseren Geschichten behoben haben.

Anthropic-CEO Dario Amodei warnt, dass KI Software-Burggräben zerstört. Erfahren Sie, wie die „SaaS-pokalypse“ die Technologie- und Finanzbranche neu gestaltet.

Anthropic kooperiert mit SpaceXAI für Zugriff auf Colossus 1 und erforscht orbitale KI-Rechenleistung, um Energie- und Kühlungsgrenzen der Erde für Claude KI zu überwinden.

Wir sehen uns auf der anderen Seite.

Unsere Ende-zu-Ende-verschlüsselte E-Mail- und Cloud-Speicherlösung bietet die leistungsfähigsten Mittel für den sicheren Datenaustausch und gewährleistet die Sicherheit und den Schutz Ihrer Daten.

/ Kostenloses Konto erstellen