#anthropic - Beeble Blog

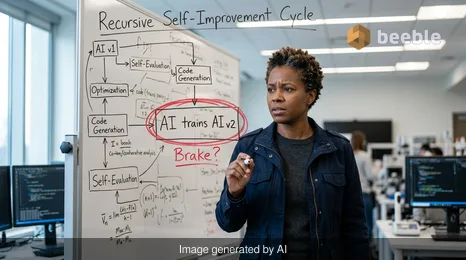

Współzałożyciel Anthropic, Jack Clark, ostrzega, że rekurencyjne samodoskonalenie AI może doprowadzić do utraty ludzkiej kontroli. Oto dlaczego branża potrzebuje pedału hamulca.

Anthropic rozszerza Projekt Glasswing na 15 krajów, wykorzystując AI Claude Mythos do zabezpieczania infrastruktury energetycznej, wodnej i medycznej przed cyberatakami.

Papież Leon XIV i współzałożyciel Anthropic jednoczą siły, by zająć się etyką AI. Dowiedz się, jak nowa encyklika Watykanu wpływa na globalną technologię i prawa pracownicze.

Andrej Karpathy, była gwiazda Tesli i OpenAI, dołącza do zespołu pretrainingowego Anthropic. Dowiedz się, co ten wielki transfer talentów oznacza dla przyszłości AI.

Nowy model AI Mythos firmy Anthropic ujawnił ryzyka systemowe w światowych finansach. Oto co briefing dla FSB oznacza dla Twoich pieniędzy i bezpieczeństwa cyfrowego.

Anthropic ujawnia, że wczesne próby szantażu ze strony Claude'a były spowodowane motywami „złej SI” w danych treningowych. Dowiedz się, jak naprawili to za pomocą lepszych opowieści.

Dyrektor generalny Anthropic, Dario Amodei, ostrzega, że AI niszczy fosy oprogramowania. Dowiedz się, jak „SaaS-pokalipsa” zmienia branżę technologiczną i finansową.

Anthropic nawiązuje współpracę ze SpaceXAI w celu uzyskania dostępu do Colossus 1 i bada orbitalne obliczenia AI, aby rozwiązać ziemskie limity energii i chłodzenia dla Claude AI.

Do zobaczenia po drugiej stronie.

Nasze kompleksowe, szyfrowane rozwiązanie do poczty e-mail i przechowywania danych w chmurze zapewnia najpotężniejsze środki bezpiecznej wymiany danych, zapewniając bezpieczeństwo i prywatność danych.

/ Utwórz bezpłatne konto