Le système FaceBoarding de Milan prouve que l’efficacité ne peut contourner les droits fondamentaux

Dans le monde physique, nous avons l’habitude de présenter un passeport à un agent humain, un bref échange où nous gardons le contrôle de nos documents d’identité. En ligne et dans les zones de transit automatisées, cependant, cette dynamique se transforme en quelque chose de bien plus opaque. On nous demande souvent d’échanger nos données les plus intimes — la géométrie de nos visages — contre la promesse d’une file d’attente plus courte. Mais comme le révèle une décision récente de l’Autorité italienne de protection des données (le Garante), le prix de cette commodité est souvent plus élevé que ce que les passagers réalisent.

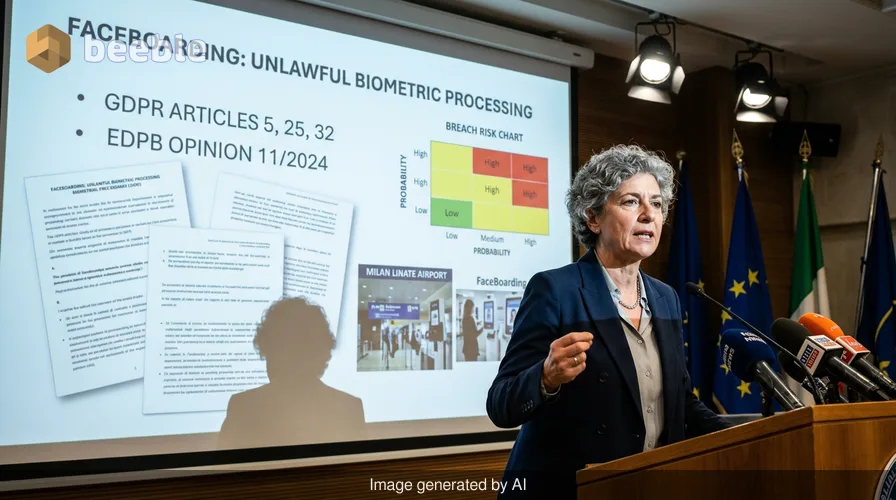

À l’aéroport de Milan Linate, le système FaceBoarding a été commercialisé comme un saut technologique fluide vers l’avenir du voyage. En scannant leur visage, les passagers pouvaient franchir la sécurité et les portes d’embarquement sans avoir à chercher des codes papier ou numériques. Pourtant, l’enquête du Garante sur la SEA (Società Esercizi Aeroportuali) a levé le voile sur un système qui ne respectait pas les lois mêmes conçues pour nous protéger. Du point de vue de la conformité, cette décision rappelle une vérité brutale : l’innovation sans fondement de confidentialité n’est qu’une forme sophistiquée de risque.

L’illusion du consentement

L’une des conclusions les plus significatives de la décision du Garante a été l’absence de consentement valide. Dans le monde de la protection des données, le consentement est la clé qui ouvre la porte au traitement des informations sensibles. Pour les données biométriques — que le RGPD classe comme une catégorie spéciale car elles sont liées de manière unique et permanente à un individu — cette clé doit être tournée par l’utilisateur de manière libre et explicite.

En pratique, il a été constaté que la SEA avait acquis des images faciales de passagers sans obtenir le consentement granulaire requis par la loi. En d’autres termes, les passagers n’ont pas eu de choix clair et éclairé ; ils ont simplement été canalisés vers un système qui traitait leurs traits biologiques comme un simple bagage supplémentaire. Dans le cadre du RGPD, on ne peut pas supposer qu’une personne accepte que son visage soit numérisé et stocké simplement parce qu’elle se dirige vers une porte spécifique.

Une fondation bâtie sur le sable

La protection de la vie privée dès la conception (Privacy by design) est la fondation d’une maison. Si vous construisez une structure moderne et élégante sur une fondation fragile, l’ensemble du bâtiment reste précaire. Le Garante a constaté que la SEA n’avait pas mis en œuvre ce principe, violant l’article 25 du RGPD. Au lieu d’intégrer la protection de la vie privée dans le logiciel dès la première ligne de code, le système a traité la protection des données comme une réflexion après coup.

Ce manque d’intégrité structurelle était particulièrement évident dans les failles de sécurité du système. L’enquête a révélé que la SEA n’avait pas chiffré les modèles biométriques — les représentations mathématiques des visages des passagers. Entre les mains d’un acteur malveillant, une base de données biométriques non chiffrée est un actif toxique. Contrairement à un mot de passe, vous ne pouvez pas changer de visage après une violation de données. Par conséquent, le stockage de ces données dans un état vulnérable a créé un risque inacceptable de vol d’identité et de suivi non autorisé.

Le problème de la thésaurisation numérique

La minimisation des données est un principe fondamental de l’hygiène numérique. Elle suggère que les organisations ne devraient collecter que ce dont elles ont besoin et ne le conserver que le temps nécessaire. La SEA, cependant, a opté pour une politique de conservation excessive. En conservant les données biométriques plus longtemps que ne l’exigeait le processus d’embarquement immédiat, elle a transformé une commodité temporaire en une empreinte numérique permanente.

Cette pratique contredit directement l’avis 11/2024 du Comité européen de la protection des données (EDPB). Cette orientation récente précise que pour que les systèmes biométriques dans les aéroports soient considérés comme proportionnés, les données devraient idéalement rester sous le contrôle du passager ou être supprimées dès que l’objectif spécifique (comme l’embarquement d’un vol) est rempli. Les conserver plus longtemps transforme un outil de sécurité en une base de données de surveillance.

Pourquoi cela compte pour l’avenir du voyage

Cette décision ne concerne pas seulement un aéroport en Italie ; c’est une boussole pour toute organisation cherchant à déployer la reconnaissance faciale. Le Garante a clairement indiqué que le côté « innovant » d’une nouvelle technologie ne donne pas de licence pour ignorer l’article 32 (Sécurité du traitement) ou l’article 5 (Principes relatifs au traitement).

En fin de compte, la décision renforce l’idée que nos données biométriques constituent un droit humain fondamental, et non une marchandise à récolter pour l’efficacité opérationnelle. À mesure que nous évoluons vers des environnements plus automatisés, il incombe au responsable du traitement de prouver que ses systèmes sont robustes, transparents et, surtout, respectueux de l’individu.

Étapes pratiques pour les organisations et les voyageurs

Pour les entreprises souhaitant rester en conformité avec la loi, et pour les voyageurs désireux de protéger leur identité numérique, voici les enseignements exploitables de la décision Linate :

- Auditer les flux de travail biométriques : Si votre organisation utilise la reconnaissance faciale, vérifiez que le consentement est explicite et granulaire. Les utilisateurs doivent pouvoir se désister sans pénalité.

- Appliquer le chiffrement : Les modèles biométriques ne doivent jamais être stockés en texte clair. Utilisez un chiffrement de pointe pour garantir que même en cas de violation, les données restent inutilisables pour les intrus.

- Pratiquer la minimisation des données : Établissez des protocoles de suppression automatique stricts. Si le passager a embarqué dans l’avion, il existe rarement une raison légale de conserver son modèle facial.

- Consulter les directives de l’EDPB : Assurez-vous que vos systèmes sont conformes à l’avis 11/2024, qui définit la norme actuelle pour le traitement biométrique dans les espaces publics à forte fréquentation.

- Conseil aux voyageurs : Cherchez toujours l’alternative « analogique ». Vous avez le droit de choisir les contrôles de documents traditionnels plutôt que le scan biométrique dans la plupart des juridictions.

Sources :

- Règlement général sur la protection des données (RGPD), articles 5, 25 et 32.

- Autorité italienne de protection des données (Garante per la protezione dei dati personali) - Décision sur SEA Milan Linate.

- Avis 11/2024 du Comité européen de la protection des données (EDPB) sur l’utilisation de la reconnaissance faciale dans les aéroports.

Avertissement : Cet article est destiné à des fins informatives et journalistiques uniquement et ne constitue pas un conseil juridique formel. Pour des exigences de conformité spécifiques, consultez un professionnel du droit qualifié ou votre délégué à la protection des données.

On se retrouve de l'autre côté.

Notre solution de messagerie cryptée de bout en bout et de stockage en nuage constitue le moyen le plus puissant d'échanger des données en toute sécurité, garantissant ainsi la sûreté et la confidentialité de vos données.

/ Créer un compte gratuit