El sistema FaceBoarding de Milán demuestra que la eficiencia no puede ignorar los derechos fundamentales

En el mundo físico, estamos acostumbrados a mostrar el pasaporte a un agente humano, un breve intercambio en el que mantenemos el control de nuestros documentos de identidad. Sin embargo, en línea y en las zonas de tránsito automatizadas, esa dinámica se transforma en algo mucho más opaco. A menudo se nos pide que intercambiemos nuestros datos más íntimos —la geometría de nuestros rostros— por la promesa de una cola más corta. Pero, como revela una reciente decisión de la Autoridad Italiana de Protección de Datos (el Garante), el precio de esa conveniencia suele ser más alto de lo que los pasajeros imaginan.

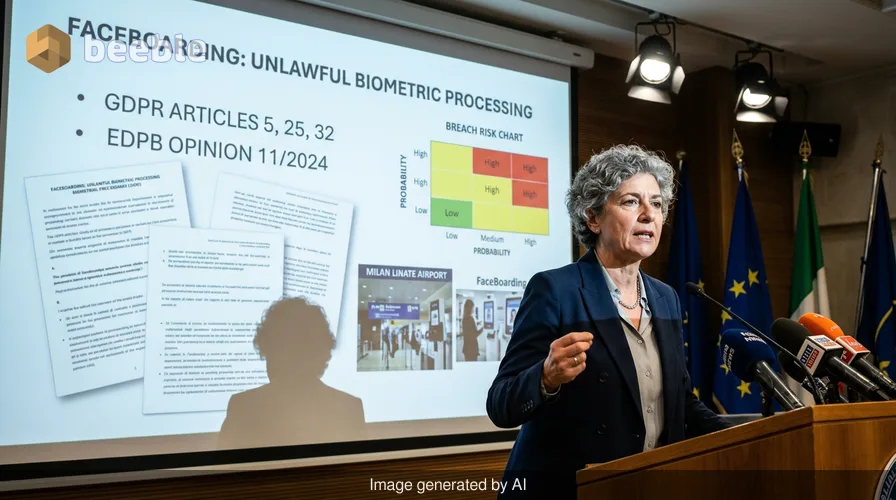

En el aeropuerto de Milán Linate, el sistema FaceBoarding se comercializó como un salto fluido hacia el futuro de los viajes. Al escanear sus rostros, los pasajeros podían pasar rápidamente por los controles de seguridad y las puertas de embarque sin tener que buscar códigos digitales o en papel. No obstante, la investigación del Garante sobre SEA (Società Esercizi Aeroportuali) ha descorrido el telón de un sistema que no respetaba las leyes diseñadas para protegernos. Desde el punto de vista del cumplimiento, el fallo sirve como un recordatorio contundente: la innovación sin una base de privacidad es simplemente una forma sofisticada de riesgo.

La ilusión del consentimiento

Uno de los hallazgos más significativos en la decisión del Garante fue la falta de un consentimiento válido. En el mundo de la protección de datos, el consentimiento es la llave que abre la puerta al tratamiento de información sensible. Para los datos biométricos —que el RGPD clasifica como una categoría especial porque están vinculados de forma única y permanente a un individuo—, esta llave debe ser girada por el usuario de forma libre y explícita.

En la práctica, se descubrió que SEA había adquirido imágenes faciales de los pasajeros sin obtener el consentimiento granular exigido por la ley. Dicho de otro modo, a los pasajeros no se les dio una opción clara e informada; simplemente se les canalizó hacia un sistema que trataba sus rasgos biológicos como una pieza más de equipaje. Bajo el marco del RGPD, no se puede asumir que alguien acepta que su rostro sea digitalizado y almacenado solo porque camina hacia una puerta específica.

Unos cimientos construidos sobre arena

La privacidad desde el diseño es los cimientos de una casa. Si se construye una estructura elegante y moderna sobre unos cimientos débiles, todo el edificio permanece precario. El Garante determinó que SEA no aplicó este principio, violando el Artículo 25 del RGPD. En lugar de integrar la privacidad en el software desde la primera línea de código, el sistema trató la protección de datos como una consideración secundaria.

Esta falta de integridad estructural fue más evidente en los fallos de seguridad del sistema. La investigación reveló que SEA no cifró las plantillas biométricas —las representaciones matemáticas de los rostros de los pasajeros—. En manos de un actor malintencionado, una base de datos biométricos sin cifrar es un activo tóxico. A diferencia de una contraseña, no puedes cambiar tu rostro después de una filtración de datos. En consecuencia, almacenar estos datos en un estado vulnerable creó un riesgo inaceptable de robo de identidad y rastreo no autorizado.

El problema del acaparamiento digital

La minimización de datos es un principio fundamental de la higiene digital. Sugiere que las organizaciones solo deben recopilar lo que necesitan y conservarlo solo durante el tiempo necesario. SEA, sin embargo, optó por una política de retención excesiva. Al conservar los datos biométricos durante más tiempo del requerido por el proceso de embarque inmediato, convirtieron una conveniencia temporal en una huella digital permanente.

Esta práctica contradice directamente el Dictamen 11/2024 del Comité Europeo de Protección de Datos (CEPD). Esta guía reciente aclara que, para que los sistemas biométricos en los aeropuertos se consideren proporcionados, lo ideal es que los datos permanezcan bajo el control del pasajero o se eliminen en el momento en que se cumpla el propósito específico (como embarcar en un vuelo). Mantenerlos por más tiempo transforma una herramienta de seguridad en una base de datos de vigilancia.

Por qué esto es importante para el futuro de los viajes

Este fallo no se trata solo de un aeropuerto en Italia; es una brújula para cualquier organización que busque implementar el reconocimiento facial. El Garante ha dejado claro que el "factor innovador" de la nueva tecnología no otorga una licencia para ignorar el Artículo 32 (Seguridad del tratamiento) o el Artículo 5 (Principios relativos al tratamiento).

En última instancia, la decisión refuerza la idea de que nuestros datos biométricos son un derecho humano fundamental, no una mercancía que se deba cosechar para la eficiencia operativa. A medida que avanzamos hacia entornos más automatizados, la responsabilidad recae en el responsable del tratamiento para demostrar que sus sistemas son robustos, transparentes y, sobre todo, respetuosos con el individuo.

Pasos prácticos para organizaciones y viajeros

Para las empresas que buscan mantenerse en el lado correcto de la ley y para los viajeros que desean proteger su identidad digital, estas son las conclusiones prácticas de la decisión de Linate:

- Auditar los flujos de trabajo biométricos: Si su organización utiliza el reconocimiento facial, verifique que el consentimiento sea explícito y granular. Los usuarios deben poder optar por no participar sin penalización.

- Imponer el cifrado: Las plantillas biométricas nunca deben almacenarse en texto plano. Utilice cifrado de última generación para garantizar que, incluso si ocurre una brecha, los datos sigan siendo inútiles para los intrusos.

- Practicar la minimización de datos: Establezca protocolos estrictos de eliminación automática. Si el pasajero ha subido al avión, rara vez existe una razón legal para conservar su plantilla facial.

- Revisar las directrices del CEPD: Asegúrese de que sus sistemas se alineen con el Dictamen 11/2024, que establece el estándar actual para el procesamiento biométrico en espacios públicos de alto tráfico.

- Consejo para el viajero: Busque siempre la alternativa "analógica". Usted tiene derecho a elegir los controles de documentos tradicionales en lugar del escaneo biométrico en la mayoría de las jurisdicciones.

Fuentes:

- Reglamento General de Protección de Datos (RGPD), Artículos 5, 25 y 32.

- Autoridad Italiana de Protección de Datos (Garante per la protezione dei dati personali) - Decisión sobre SEA Milan Linate.

- Comité Europeo de Protección de Datos (CEPD) Dictamen 11/2024 sobre el uso del reconocimiento facial en aeropuertos.

Descargo de responsabilidad: Este artículo tiene fines informativos y periodísticos únicamente y no constituye asesoramiento legal formal. Para requisitos de cumplimiento específicos, consulte con un profesional legal calificado o con su Delegado de Protección de Datos.

Nos vemos en el otro lado.

Nuestra solución de correo electrónico cifrado y almacenamiento en la nube de extremo a extremo proporciona los medios más potentes para el intercambio seguro de datos, lo que garantiza la seguridad y la privacidad de sus datos.

/ Crear una cuenta gratuita