Mailands FaceBoarding-System beweist, dass Effizienz Grundrechte nicht umgehen kann

In der physischen Welt sind wir daran gewöhnt, einem menschlichen Beamten einen Reisepass vorzuzeigen – ein kurzer Austausch, bei dem wir die Kontrolle über unsere Ausweisdokumente behalten. Online und in automatisierten Transitzonen verschiebt sich diese Dynamik jedoch in etwas weitaus Undurchsichtigeres. Wir werden oft aufgefordert, unsere intimsten Daten – die Geometrie unseres Gesichts – gegen das Versprechen einer kürzeren Warteschlange einzutauschen. Doch wie eine jüngste Entscheidung der italienischen Datenschutzbehörde (Garante) zeigt, ist der Preis für diesen Komfort oft höher, als den Passagieren bewusst ist.

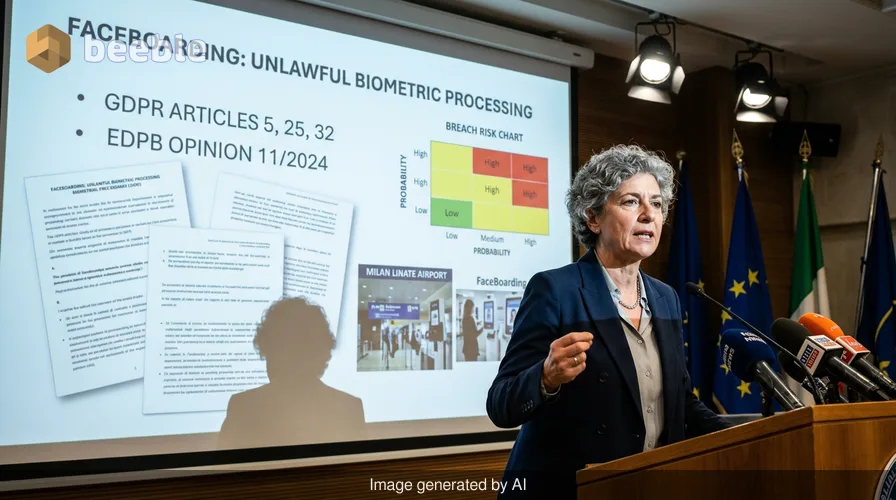

Am Flughafen Mailand-Linate wurde das FaceBoarding-System als nahtloser Sprung in die Zukunft des Reisens vermarktet. Durch das Scannen ihrer Gesichter konnten Passagiere die Sicherheitskontrollen und Boarding-Gates passieren, ohne nach Papier oder digitalen Codes suchen zu müssen. Doch die Untersuchung der Garante gegen die SEA (Società Esercizi Aeroportuali) hat den Vorhang über einem System gelüftet, das genau die Gesetze missachtete, die uns schützen sollen. Aus Sicht der Compliance dient das Urteil als deutliche Mahnung: Innovation ohne ein Fundament aus Datenschutz ist lediglich eine hochentwickelte Form von Risiko.

Die Illusion der Einwilligung

Eines der bedeutendsten Ergebnisse der Entscheidung der Garante war das Fehlen einer wirksamen Einwilligung. In der Welt des Datenschutzes ist die Einwilligung der Schlüssel, der die Tür zur Verarbeitung sensibler Informationen öffnet. Für biometrische Daten – die die DSGVO als besondere Kategorie klassifiziert, da sie eindeutig und dauerhaft mit einer Person verknüpft sind – muss dieser Schlüssel vom Nutzer freiwillig und ausdrücklich gedreht werden.

In der Praxis wurde festgestellt, dass die SEA Gesichtsbilder von Passagieren erfasst hatte, ohne die gesetzlich erforderliche granulare Einwilligung einzuholen. Anders ausgedrückt: Den Passagieren wurde keine klare, informierte Wahl gelassen; sie wurden einfach in ein System geschleust, das ihre biologischen Merkmale wie ein weiteres Gepäckstück behandelte. Unter dem Rahmenwerk der DSGVO kann man nicht davon ausgehen, dass jemand der Digitalisierung und Speicherung seines Gesichts zustimmt, nur weil er auf ein bestimmtes Gate zugeht.

Ein auf Sand gebautes Fundament

Privacy by Design (Datenschutz durch Technikgestaltung) ist das Fundament eines Hauses. Wenn man eine elegante, moderne Struktur auf einem schwachen Fundament errichtet, bleibt das gesamte Gebäude prekär. Die Garante stellte fest, dass die SEA diesen Grundsatz nicht umgesetzt und damit gegen Artikel 25 der DSGVO verstoßen hat. Anstatt den Datenschutz von der ersten Codezeile an in die Software einzubauen, behandelte das System den Datenschutz als nebensächlich.

Dieser Mangel an struktureller Integrität zeigte sich am deutlichsten in den Sicherheitsmängeln des Systems. Die Untersuchung ergab, dass die SEA es versäumt hatte, die biometrischen Templates – die mathematischen Darstellungen der Gesichter der Passagiere – zu verschlüsseln. In den Händen eines böswilligen Akteurs ist eine unverschlüsselte biometrische Datenbank ein toxischer Vermögenswert. Im Gegensatz zu einem Passwort kann man sein Gesicht nach einer Datenpanne nicht ändern. Folglich schuf die Speicherung dieser Daten in einem ungeschützten Zustand ein inakzeptables Risiko für Identitätsdiebstahl und unbefugtes Tracking.

Das Problem des digitalen Hortens

Datenminimierung ist ein Kernprinzip der digitalen Hygiene. Sie besagt, dass Organisationen nur das sammeln sollten, was sie benötigen, und es nur so lange aufbewahren sollten, wie es notwendig ist. Die SEA entschied sich jedoch für eine Politik der übermäßigen Speicherung. Indem sie biometrische Daten länger aufbewahrten, als es der unmittelbare Boarding-Prozess erforderte, machten sie aus einer vorübergehenden Bequemlichkeit einen dauerhaften digitalen Fußabdruck.

Diese Praxis widerspricht direkt der Stellungnahme 11/2024 des Europäischen Datenschutzausschusses (EDSA). Diese aktuelle Leitlinie stellt klar, dass biometrische Systeme in Flughäfen nur dann als verhältnismäßig gelten, wenn die Daten idealerweise unter der Kontrolle des Passagiers bleiben oder in dem Moment gelöscht werden, in dem der spezifische Zweck (wie das Boarding eines Fluges) erfüllt ist. Eine längere Aufbewahrung verwandelt ein Sicherheitswerkzeug in eine Überwachungsdatenbank.

Warum dies für die Zukunft des Reisens wichtig ist

Dieses Urteil betrifft nicht nur einen Flughafen in Italien; es ist ein Kompass für jede Organisation, die Gesichtserkennung einsetzen möchte. Die Garante hat deutlich gemacht, dass der "Coolness-Faktor" neuer Technologien keine Lizenz erteilt, Artikel 32 (Sicherheit der Verarbeitung) oder Artikel 5 (Grundsätze der Verarbeitung) zu ignorieren.

Letztendlich bekräftigt die Entscheidung die Vorstellung, dass unsere biometrischen Daten ein grundlegendes Menschenrecht sind und kein Rohstoff, der für die betriebliche Effizienz geerntet werden kann. Während wir uns auf stärker automatisierte Umgebungen zubewegen, liegt die Last beim Verantwortlichen nachzuweisen, dass seine Systeme robust, transparent und vor allem respektvoll gegenüber dem Einzelnen sind.

Praktische Schritte für Organisationen und Reisende

Für Unternehmen, die auf der richtigen Seite des Gesetzes bleiben wollen, und für Reisende, die ihre digitale Identität schützen möchten, sind hier die umsetzbaren Erkenntnisse aus der Linate-Entscheidung:

- Überprüfung biometrischer Workflows: Wenn Ihre Organisation Gesichtserkennung einsetzt, stellen Sie sicher, dass die Einwilligung ausdrücklich und granular erfolgt. Nutzer müssen in der Lage sein, sich ohne Nachteile dagegen zu entscheiden.

- Verschlüsselung erzwingen: Biometrische Templates sollten niemals im Klartext gespeichert werden. Verwenden Sie modernste Verschlüsselung, um sicherzustellen, dass die Daten selbst im Falle einer Sicherheitsverletzung für Eindringlinge nutzlos bleiben.

- Datenminimierung praktizieren: Legen Sie strikte Protokolle zur automatischen Löschung fest. Wenn der Passagier das Flugzeug bestiegen hat, gibt es selten einen rechtmäßigen Grund, sein Gesichtstemplate aufzubewahren.

- EDSA-Leitlinien prüfen: Stellen Sie sicher, dass Ihre Systeme mit der Stellungnahme 11/2024 übereinstimmen, die den aktuellen Standard für die biometrische Verarbeitung in stark frequentierten öffentlichen Räumen setzt.

- Tipp für Reisende: Suchen Sie immer nach der "analogen" Alternative. Sie haben in den meisten Gerichtsbarkeiten das Recht, traditionelle Dokumentenprüfungen gegenüber biometrischen Scans zu bevorzugen.

Quellen:

- Datenschutz-Grundverordnung (DSGVO), Artikel 5, 25 und 32.

- Italienische Datenschutzbehörde (Garante per la protezione dei dati personali) - Entscheidung zu SEA Mailand Linate.

- Europäischer Datenschutzausschuss (EDSA) Stellungnahme 11/2024 über die Verwendung von Gesichtserkennung in Flughäfen.

Haftungsausschluss: Dieser Artikel dient ausschließlich Informations- und journalistischen Zwecken und stellt keine formelle Rechtsberatung dar. Für spezifische Compliance-Anforderungen konsultieren Sie bitte einen qualifizierten Rechtsexperten oder Ihren Datenschutzbeauftragten.

Wir sehen uns auf der anderen Seite.

Unsere Ende-zu-Ende-verschlüsselte E-Mail- und Cloud-Speicherlösung bietet die leistungsfähigsten Mittel für den sicheren Datenaustausch und gewährleistet die Sicherheit und den Schutz Ihrer Daten.

/ Kostenloses Konto erstellen