Perché la tua fabbrica locale potrebbe presto essere gestita da un robot con un "Visual Scratchpad"

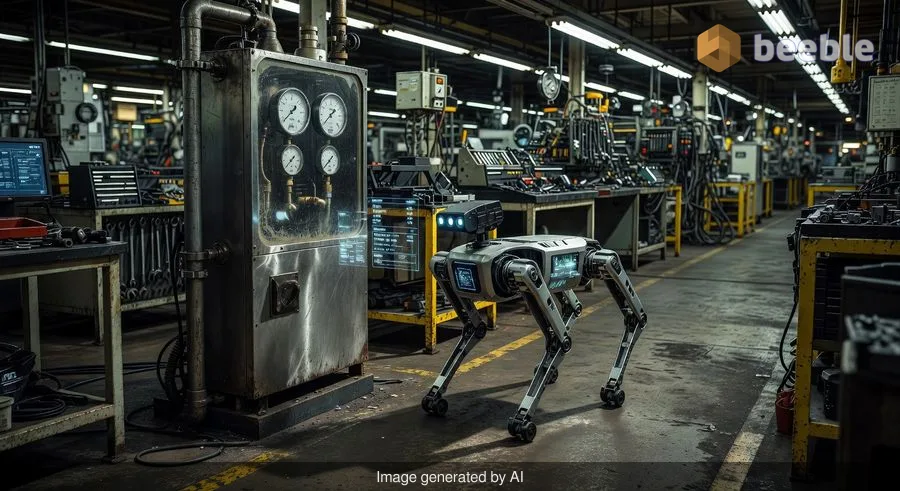

Immaginate un instancabile stagista che si aggira in un vasto complesso industriale. Questo stagista non ha bisogno di caffè, non si annoia mai di fissare lo stesso manometro per la millesima volta e ora può distinguere tra un bullone leggermente allentato e un guasto catastrofico a una tubatura con la precisione di un ingegnere esperto. Questa non è una scena di un reboot di fantascienza; è il risultato tangibile dell'ultima collaborazione tra Google DeepMind e Boston Dynamics.

Il 14 aprile 2026, Google ha annunciato il rilascio di Gemini Robotics-ER 1.6, un modello di IA specializzato progettato per dotare i robot come il quadrupede Spot di un "ragionamento incarnato" (embodied reasoning). In termini semplici, ciò significa che il robot non è più solo una telecamera telecomandata. Sta iniziando a comprendere il mondo fisico in cui vive, passando da semplice strumento a ispettore autonomo capace di leggere quadranti analogici e identificare attrezzi in una stanza disordinata con un'accuratezza quasi umana.

La fine del robot "cieco"

Storicamente, i robot sono stati eccellenti nella ripetitività ma pessimi nell'osservazione. Se programmavi un braccio robotico per saldare a punti la portiera di un'auto, lo faceva perfettamente un milione di volte. Tuttavia, se quella portiera veniva spostata di cinque centimetri a sinistra, il robot avrebbe probabilmente continuato a saldare il vuoto. Questa mancanza di adattabilità ha confinato i robot in ambienti altamente controllati come le linee di assemblaggio.

Sotto il cofano di questo nuovo aggiornamento c'è qualcosa che Google chiama "visione agentica" (agentic vision). Pensatela come a un blocco per appunti visivo (visual scratchpad). Quando il robot osserva una scena complessa — ad esempio, una parete con 50 diversi manometri analogici in una vecchia centrale elettrica — non scatta solo una foto. Utilizza il modello di IA per "puntare" elementi specifici, eseguire piccoli frammenti di codice per verificare ciò che vede e ragionare sui dati.

In termini pratici, questo ha portato a un enorme balzo in avanti nelle prestazioni. La versione precedente di questo modello, la 1.5, riusciva a leggere correttamente gli strumenti solo nel 23% dei casi circa. Il nuovo modello 1.6 ha fatto impennare l'accuratezza a uno sbalorditivo 98%. Per l'utente medio, questa è la differenza tra un GPS che occasionalmente ti dice di guidare dentro un lago e uno che naviga in un complesso incrocio a cinque vie senza battere ciglio.

Perché i manometri analogici contano ancora in un mondo digitale

Potrebbe sembrare controintuitivo spendere milioni di dollari per insegnare a un cane robotico ad alta tecnologia come leggere un termometro analogico di 50 anni fa. Perché non sostituire semplicemente il termometro con un sensore digitale che invia dati al cloud?

Guardando il quadro generale, la spina dorsale industriale globale è incredibilmente resiliente — e incredibilmente vecchia. Sostituire ogni valvola manuale, spia di livello e manometro in una raffineria o in un impianto automobilistico Hyundai costerebbe miliardi e richiederebbe mesi di inattività. È molto più scalabile dare a un robot gli "occhi" per leggere le attrezzature esistenti piuttosto che ricostruire il mondo per adattarlo al robot.

È qui che la partnership con Boston Dynamics diventa fondamentale. Il loro robot, Spot, è già in fase di sperimentazione in strutture di proprietà di Hyundai Motor Group. Utilizzando Gemini Robotics-ER 1.6, Spot può ora eseguire un "ragionamento multi-vista". Può utilizzare i suoi vari flussi video per comprendere l'ambiente in 3D, assicurandosi non solo di vedere un manometro, ma di capire dove si trova rispetto al resto dei macchinari.

Risolvere il problema delle "allucinazioni"

Uno dei maggiori ostacoli per l'IA nel mondo fisico è l' "allucinazione" — la tendenza dei modelli ad affermare con sicurezza che qualcosa è presente quando non lo è. In un chatbot, un'allucinazione è un'anomalia divertente; in un contesto di industria pesante dove un robot monitora sostanze chimiche volatili, un'allucinazione è un incubo per la sicurezza.

I test di Google hanno dimostrato che il modello 1.6 è molto più bravo a rimanere ancorato alla realtà. In un test che coinvolgeva un tavolo disordinato pieno di attrezzi, il modello precedente "vedeva" una carriola che non esisteva solo perché gli era stato chiesto di cercarne una. Il nuovo modello, al contrario, ha identificato correttamente martelli, forbici e pinze ignorando la domanda "trabocchetto". Questa migliore accuratezza è fondamentale per far uscire i robot dai laboratori e portarli nel mondo reale, disordinato e imprevedibile.

| Funzionalità | Gemini Robotics-ER 1.5 | Gemini Robotics-ER 1.6 | Gemini 3.0 Flash |

|---|---|---|---|

| Accuratezza Lettura Strumenti | 23% | 98% | 67% |

| Ragionamento Visivo | Base | Agentico (Visual Scratchpad) | Standard |

| Vincoli di Sicurezza | Manuali | Integrati/Sistemici | Generali |

| Tasso di Allucinazione | Alto | Basso | Moderato |

La sicurezza prima di tutto: il robot come guardiano

Oltre alla semplice lettura dei quadranti, il nuovo modello è descritto come il più sicuro mai realizzato da Google. È stato addestrato per comprendere i vincoli di sicurezza fisica, come ad esempio come maneggiare liquidi senza versarli o come muoversi attorno agli esseri umani.

Per dirla in altro modo, l'IA sta imparando le regole del "buon senso" del mondo fisico. Ora può percepire il rischio di lesioni in scenari complessi — come riconoscere che un bambino vicino a una presa elettrica è una situazione ad alto rischio. Sebbene siamo ancora lontani da un robot con una comprensione dell'etica a livello umano, questi passi incrementali verso il "ragionamento incarnato" sono essenziali per il futuro decentralizzato della robotica, dove le macchine lavorano al nostro fianco invece che dietro una recinzione di sicurezza.

Cosa significa questo per te

Dal punto di vista del consumatore, probabilmente non avrai presto un cane Spot che legge il termostato di casa tua. Tuttavia, gli effetti a cascata sono significativi.

- Costi inferiori, meno guasti: man mano che le strutture industriali diventano più efficienti e meno soggette a errori umani o guasti alle apparecchiature, il costo di produzione dei beni — dalle auto all'elettricità — diventa più stabile.

- La democratizzazione della visione: la tecnologia di "visione agentica" sviluppata qui finirà per ricadere sui dispositivi di consumo. Immagina un'app per smartphone che non si limita a scattare una foto della tua scatola dei fusibili, ma ti dice esattamente quale interruttore è scattato e perché.

- Standard di sicurezza: stiamo assistendo alla nascita di un nuovo quadro di sicurezza per l'IA. Man mano che questi modelli imparano a rispettare i confini fisici, preparano la strada per assistenti domestici e robot di consegna più avanzati che siano realmente sicuri da avere intorno.

In definitiva, non si tratta solo di un cane robot che guarda un termometro. Si tratta della fusione dell'intelligenza digitale con la presenza fisica. Ci stiamo muovendo verso un mondo in cui il "petrolio greggio digitale" dei dati viene estratto e raffinato da macchine che possono finalmente vedere il mondo chiaramente come lo vediamo noi.

Mentre svolgi le tue attività quotidiane, prenditi un momento per osservare la meccanica industriale invisibile intorno a te — i tubi nel tuo seminterrato, i contatori sul lato della tua casa, i complessi macchinari nel retro di un supermercato. Per decenni, questi hanno richiesto un paio di occhi umani per restare sicuri. Stiamo entrando in un'era in cui quegli occhi non battono mai ciglio, non si stancano mai e — grazie a un blocco per appunti visivo — raramente commettono un errore.

Ci vediamo dall'altra parte.

La nostra soluzione di archiviazione e-mail crittografata end-to-end fornisce i mezzi più potenti per lo scambio sicuro dei dati, garantendo la sicurezza e la privacy dei tuoi dati.

/ Creare un account gratuito