为什么你当地的工厂很快就会由一个带有“视觉草稿卡”的机器人管理

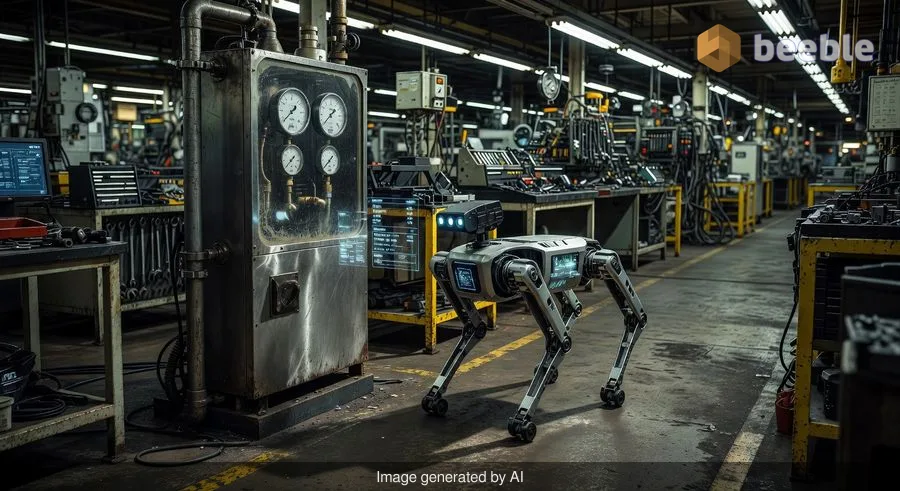

想象一下,一个不知疲倦的实习生在庞大的工业园区中穿梭。这个实习生不需要咖啡,永远不会因为第千次盯着同一个压力表而感到厌烦,而且现在能以资深工程师的精度分辨出轻微松动的螺栓和灾难性的管道故障。这不是科幻重启电影中的场景;这是谷歌 DeepMind 与波士顿动力(Boston Dynamics)最新合作的切实成果。

2026年4月14日,谷歌宣布发布 Gemini Robotics-ER 1.6,这是一款专门的 AI 模型,旨在赋予像四足机器人 Spot 这样的机器以“具身推理”能力。简单来说,这意味着机器人不再仅仅是一个远程控制的摄像头。它开始理解它所处的物理世界,从一个简单的工具转变为一个能够读取模拟仪表并在杂乱的房间中以接近人类的准确度识别工具的自主巡检员。

“盲目”机器人的终结

从历史上看,机器人非常擅长重复性工作,但在观察方面却表现糟糕。如果你编写程序让机械臂对车门进行点焊,它会完美地执行一百万次。然而,如果那个车门向左移动了两英寸,机器人很可能会继续对着空气焊接。这种缺乏适应性的问题使机器人一直被局限在像装配线这样高度受控的环境中。

这次新更新的核心是谷歌称之为“智能体视觉”(agentic vision)的技术。可以把它想象成一个视觉草稿卡。当机器人观察一个复杂的场景时——比如老旧发电厂里一墙 50 个不同的模拟仪表——它不仅仅是拍张照片。它使用 AI 模型来“指向”特定元素,执行一小段代码来验证它所看到的内容,并通过数据进行推理。

从实际应用来看,这带来了性能上的巨大飞跃。该模型的上一个版本(1.5 版)正确读取仪表的概率仅为 23% 左右。而新的 1.6 模型将这一准确率飙升至惊人的 98%。对于普通用户来说,这就像是一个偶尔让你开车掉进湖里的 GPS 与一个能毫不费力地在复杂的五路交叉口导航的 GPS 之间的区别。

为什么在数字世界中模拟仪表依然重要

花数百万美元教一只高科技机器人狗如何读取有 50 年历史的模拟温度计,这似乎有悖常理。为什么不直接用一个能将数据发送到云端的数字传感器来替换温度计呢?

从大局来看,全球工业骨干力量极其坚韧,但也极其陈旧。更换炼油厂或现代汽车工厂中的每一个手动阀门、视镜和压力表将耗资数十亿美元,并需要数月的停工时间。赋予机器人“眼睛”来读取现有设备,比为了适应机器人而重建世界要具有高得多的可扩展性。

这正是与波士顿动力合作的关键所在。他们的机器人 Spot 已经在现代汽车集团旗下的设施中进行测试。通过使用 Gemini Robotics-ER 1.6,Spot 现在可以执行“多视图推理”。它可以利用其各种摄像头流来 3D 地理解环境,确保它不仅能看到仪表,还能理解该仪表相对于其他机械设备的位置。

解决“幻觉”问题

物理世界中 AI 面临的最大障碍之一是“幻觉”——即模型倾向于自信地断言某物存在而实际上并不存在。在聊天机器人中,幻觉是一个有趣的怪癖;但在机器人监测挥发性化学物质的重工业环境中,幻觉就是一场安全噩梦。

谷歌的测试表明,1.6 模型在保持现实感方面表现得更好。在一次涉及杂乱工具桌的测试中,旧模型因为被要求寻找手推车而“看到”了一个并不存在的手推车。相反,新模型正确识别了锤子、剪刀和钳子,同时忽略了那个“陷阱”问题。这种准确性的提高是将机器人从实验室推向混乱、不可预测的现实世界的基础。

| 功能 | Gemini Robotics-ER 1.5 | Gemini Robotics-ER 1.6 | Gemini 3.0 Flash |

|---|---|---|---|

| 仪表读取准确率 | 23% | 98% | 67% |

| 视觉推理 | 基础级 | 智能体级 (视觉草稿卡) | 标准级 |

| 安全约束 | 手动 | 集成/系统化 | 通用 |

| 幻觉率 | 高 | 低 | 中等 |

安全第一:作为守护者的机器人

除了读取仪表外,新模型被描述为谷歌迄今为止最安全的模型。它经过训练以理解物理安全约束,例如如何在不溢出的情况下处理液体,或者如何在人类周围导航。

换句话说,AI 正在学习物理世界的“常识”规则。它现在可以感知复杂场景中的受伤风险——比如识别出电源插座附近的孩子是一个高风险情况。虽然我们距离机器人拥有人类水平的伦理理解还很遥远,但这些迈向“具身推理”的渐进步骤对于机器人技术的去中心化未来至关重要,在那个未来,机器将与我们并肩工作,而不是待在安全围栏后面。

这对你意味着什么

从消费者的角度来看,你可能短期内不会让 Spot 狗来读取你家的恒温器。然而,其下游效应是显著的。

- 更低的成本,更少的故障:随着工业设施变得更高效,且更不容易受到人为错误或设备故障的影响,从汽车到电力等制成品的成本将变得更加稳定。

- 视觉的民主化:这里开发的“智能体视觉”技术最终将渗透到消费设备中。想象一个智能手机应用程序,它不仅能拍下你保险丝盒的照片,还能准确地告诉你哪个开关跳闸了以及原因。

- 安全标准:我们正在见证 AI 新安全框架的诞生。随着这些模型学会尊重物理边界,它们为更先进的家用助手和送货机器人奠定了基础,使其在人类身边真正安全。

最终,这不仅仅是关于一只机器人狗盯着温度计看。它是关于数字智能与物理存在的融合。我们正在走向一个世界,在这个世界里,数据的“数字原油”正由那些终于能像我们一样清晰看世界的机器进行提取和提炼。

当你开始一天的生活时,请花点时间观察你周围隐形的工业机械——地下室的管道、房子侧面的电表、杂货店后面的复杂机械。几十年来,这些都需要人类的眼睛来保持安全。我们现在正进入一个时代,那些眼睛永不眨眼、永不疲倦,并且——多亏了视觉草稿卡——极少出错。