Dlaczego Twoja lokalna fabryka może wkrótce być zarządzana przez robota z „wizualnym brudnopisem”

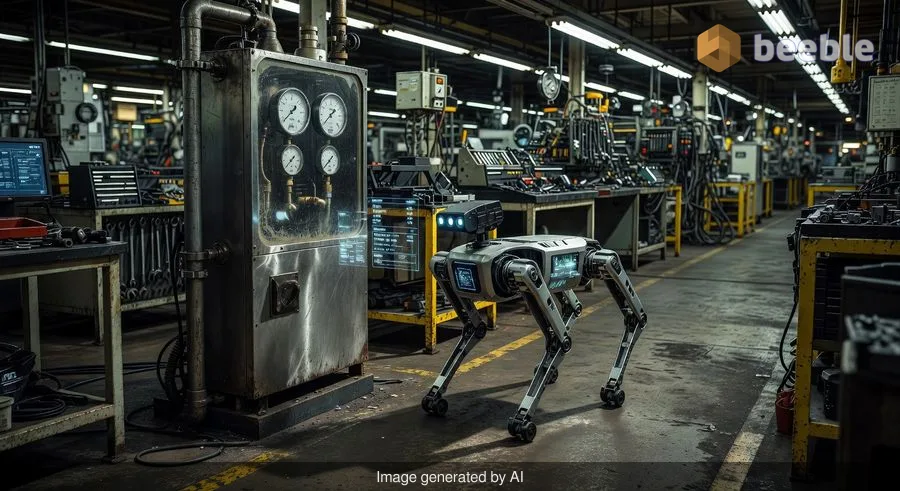

Wyobraź sobie niestrudzonego stażystę wędrującego przez rozległy kompleks przemysłowy. Ten stażysta nie potrzebuje kawy, nigdy nie nudzi się wpatrywaniem w ten sam manometr po raz tysięczny i potrafi teraz odróżnić lekko poluzowaną śrubę od katastrofalnej awarii rury z precyzją doświadczonego inżyniera. To nie jest scena z rebootu filmu science-fiction; to namacalny rezultat najnowszej współpracy Google DeepMind i Boston Dynamics.

On April 14, 2026, Google ogłosiło wydanie Gemini Robotics-ER 1.6, specjalistycznego modelu AI zaprojektowanego, aby zapewnić robotom takim jak czworonożny Spot „ucieleśnione rozumowanie” (embodied reasoning). W prostych słowach oznacza to, że robot nie jest już tylko zdalnie sterowaną kamerą. Zaczyna rozumieć świat fizyczny, w którym przebywa, ewoluując z prostego narzędzia w autonomicznego inspektora zdolnego do odczytywania wskaźników analogowych i identyfikowania narzędzi w zagraconym pomieszczeniu z dokładnością zbliżoną do ludzkiej.

Koniec „ślepego” robota

Historycznie roboty świetnie radziły sobie z powtarzalnością, ale fatalnie z obserwacją. Gdyby zaprogramować ramię robotyczne do zgrzewania punktowego drzwi samochodu, robiłoby to idealnie milion razy. Jeśli jednak te drzwi zostałyby przesunięte o pięć centymetrów w lewo, robot prawdopodobnie kontynuowałby zgrzewanie powietrza. Ten brak zdolności adaptacyjnych ograniczał roboty do wysoce kontrolowanych środowisk, takich jak linie montażowe.

„Pod maską” tej nowej aktualizacji kryje się coś, co Google nazywa „wizją agentyczną” (agentic vision). Pomyśl o tym jak o wizualnym brudnopisie. Kiedy robot patrzy na złożoną scenę — na przykład ścianę z 50 różnymi analogowymi wskaźnikami w starzejącej się elektrowni — nie robi tylko zdjęcia. Używa modelu AI, aby „wskazać” konkretne elementy, wykonać małe fragmenty kodu w celu weryfikacji tego, co widzi, i wyciągnąć wnioski z danych.

W praktyce doprowadziło to do ogromnego skoku wydajności. Poprzednia wersja tego modelu, wersja 1.5, poprawnie odczytywała instrumenty tylko w około 23 procentach przypadków. Nowy model 1.6 zwiększył tę dokładność do oszałamiających 98 procent. Dla przeciętnego użytkownika jest to różnica między GPS-em, który od czasu do czasu każe wjechać do jeziora, a takim, który bez trudu nawiguje przez skomplikowane pięciokierunkowe skrzyżowanie bez kropli potu.

Dlaczego wskaźniki analogowe wciąż mają znaczenie w cyfrowym świecie

Wydawać się może sprzeczne z intuicją wydawanie milionów dolarów na naukę zaawansowanego technologicznie robotycznego psa odczytywania 50-letniego termometru analogowego. Dlaczego po prostu nie zastąpić termometru cyfrowym czujnikiem przesyłającym dane do chmury?

Patrząc na szerszy obraz, globalny kręgosłup przemysłowy jest niezwykle odporny — i niezwykle stary. Wymiana każdego ręcznego zaworu, wziernika i manometru w rafinerii lub fabryce motoryzacyjnej Hyundai kosztowałaby miliardy i wymagałaby miesięcy przestojów. O wiele bardziej skalowalne jest wyposażenie robota w „oczy” do odczytu istniejącego sprzętu, niż przebudowa świata w celu dostosowania go do robota.

W tym miejscu partnerstwo z Boston Dynamics staje się kluczowe. Ich robot, Spot, jest już testowany w obiektach należących do Hyundai Motor Group. Dzięki zastosowaniu Gemini Robotics-ER 1.6, Spot może teraz wykonywać „rozumowanie wielowidokowe”. Może wykorzystywać strumienie z różnych kamer, aby rozumieć swoje otoczenie w 3D, zapewniając, że nie tylko widzi wskaźnik, ale rozumie, gdzie ten wskaźnik znajduje się w stosunku do reszty maszynerii.

Rozwiązanie problemu „halucynacji”

Jedną z największych przeszkód dla AI w świecie fizycznym są „halucynacje” — tendencja modeli do pewnego twierdzenia, że coś tam jest, gdy w rzeczywistości tego nie ma. W przypadku chatbota halucynacja jest zabawnym dziwactwem; w przemyśle ciężkim, gdzie robot monitoruje lotne chemikalia, halucynacja jest koszmarem bezpieczeństwa.

Testy Google wykazały, że model 1.6 znacznie lepiej trzyma się rzeczywistości. W teście obejmującym zagracony stół z narzędziami, starszy model „zobaczył” taczki, które nie istniały, tylko dlatego, że poproszono go o ich poszukanie. Nowy model natomiast poprawnie zidentyfikował młotki, nożyczki i szczypce, ignorując „podchwytliwe” pytanie. Ta poprawiona dokładność jest fundamentem dla wyprowadzenia robotów z laboratoriów do chaotycznego, nieprzewidywalnego świata rzeczywistego.

| Funkcja | Gemini Robotics-ER 1.5 | Gemini Robotics-ER 1.6 | Gemini 3.0 Flash |

|---|---|---|---|

| Dokładność odczytu instrumentów | 23% | 98% | 67% |

| Rozumowanie wizualne | Podstawowe | Agentyczne (Wizualny brudnopis) | Standardowe |

| Ograniczenia bezpieczeństwa | Ręczne | Zintegrowane/Systemowe | Ogólne |

| Wskaźnik halucynacji | Wysoki | Niski | Umiarkowany |

Bezpieczeństwo przede wszystkim: Robot jako opiekun

Poza samym odczytywaniem wskaźników, nowy model jest opisywany jako najbezpieczniejszy dotychczasowy model Google. Został przeszkolony w rozumieniu fizycznych ograniczeń bezpieczeństwa, takich jak obchodzenie się z cieczami bez ich rozlewania czy poruszanie się wokół ludzi.

Innymi słowy, AI uczy się zasad „zdrowego rozsądku” świata fizycznego. Potrafi teraz dostrzec ryzyko obrażeń w złożonych scenariuszach — na przykład rozpoznając, że dziecko w pobliżu gniazdka elektrycznego to sytuacja wysokiego ryzyka. Choć wciąż daleko nam do robota posiadającego ludzki poziom zrozumienia etyki, te stopniowe kroki w kierunku „ucieleśnionego rozumowania” są niezbędne dla zdecentralizowanej przyszłości robotyki, w której maszyny pracują ramię w ramię z nami, a nie za ogrodzeniem ochronnym.

Co to oznacza dla Ciebie

Z perspektywy konsumenta prawdopodobnie nie będziesz mieć w najbliższym czasie psa Spot odczytującego Twój domowy termostat. Jednak skutki wtórne są znaczące.

- Niższe koszty, mniej awarii: W miarę jak obiekty przemysłowe stają się bardziej wydajne i mniej podatne na błędy ludzkie lub awarie sprzętu, koszty wytwarzania towarów — od samochodów po energię elektryczną — stają się bardziej stabilne.

- Demokratyzacja wizji: Technologia „wizji agentycznej” opracowana tutaj ostatecznie trafi do urządzeń konsumenckich. Wyobraź sobie aplikację na smartfona, która nie tylko robi zdjęcie skrzynki bezpieczników, ale mówi dokładnie, który przełącznik został wyłączony i dlaczego.

- Standardy bezpieczeństwa: Jesteśmy świadkami narodzin nowych ram bezpieczeństwa dla AI. W miarę jak modele te uczą się respektować granice fizyczne, przygotowują grunt pod bardziej zaawansowanych asystentów domowych i roboty dostawcze, przebywanie w których otoczeniu będzie naprawdę bezpieczne.

Ostatecznie nie chodzi tylko o robotycznego psa patrzącego na termometr. Chodzi o połączenie cyfrowej inteligencji z fizyczną obecnością. Zmierzamy w stronę świata, w którym „cyfrowa ropa naftowa” danych jest wydobywana i rafinowana przez maszyny, które w końcu widzą świat tak wyraźnie jak my.

Idąc przez swój dzień, poświęć chwilę, aby przyjrzeć się niewidocznym mechanizmom przemysłowym wokół siebie — rurom w piwnicy, licznikom na ścianie domu, złożonym maszynom na zapleczu sklepu spożywczego. Przez dziesięciolecia wymagały one ludzkiej pary oczu, aby zachować bezpieczeństwo. Wchodzimy teraz w erę, w której te oczy nigdy nie mrugają, nigdy się nie męczą i — dzięki wizualnemu brudnopisowi — rzadko popełniają błąd.

Do zobaczenia po drugiej stronie.

Nasze kompleksowe, szyfrowane rozwiązanie do poczty e-mail i przechowywania danych w chmurze zapewnia najpotężniejsze środki bezpiecznej wymiany danych, zapewniając bezpieczeństwo i prywatność danych.

/ Utwórz bezpłatne konto