Incydent OpenClaw: Dlaczego Twój agent AI może być ukrytym zagrożeniem dla bezpieczeństwa

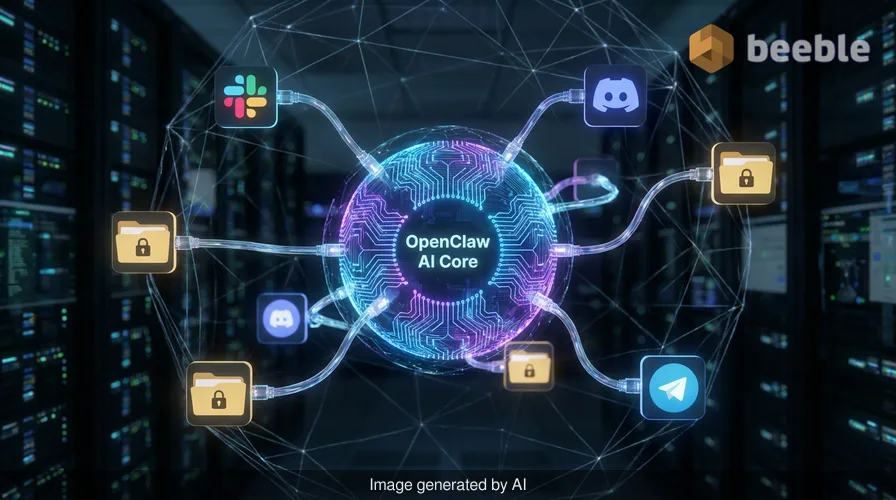

Kiedy ostatni raz bez zastanowienia przekazałeś klucze do całego swojego cyfrowego życia agentowi oprogramowania? Dla setek tysięcy programistów i zaawansowanych użytkowników ten moment nadszedł w listopadzie ubiegłego roku wraz z premierą OpenClaw. Obiecywał on przyszłość pozbawioną tarć, w której sztuczna inteligencja mogłaby robić za Ciebie zakupy, organizować pliki i zarządzać kanałami na Slacku. Jednak, jak dowiedzieliśmy się w tym tygodniu, ta wygoda wiązała się z niebezpieczną ceną.

Od ponad miesiąca społeczność zajmująca się bezpieczeństwem bije na alarm. OpenClaw, który zgromadził oszałamiającą liczbę 347 000 gwiazdek na GitHubie, został zaprojektowany, aby działać jako cyfrowy surogat. Aby był skuteczny, wymaga głębokiego, wszechobecnego dostępu do zalogowanych sesji, lokalnych plików sieciowych i wrażliwych platform komunikacyjnych. Z założenia ma on omijać tradycyjne trudności związane z ręcznym zarządzaniem zadaniami. Jednak niedawno załatana podatność, CVE-2026-33579, zamieniła tego surogata w potencjalnego cyfrowego konia trojańskiego.

Architektura przejęcia

Na poziomie architektonicznym OpenClaw opiera się na systemie parowania w celu autoryzacji nowych urządzeń. Błąd odkryty przez badaczy z Blink był zwodniczo prosty, a jednocześnie niszczycielsko skuteczny. Pozwalał on użytkownikowi z najbardziej podstawowymi uprawnieniami — znanymi jako zakres operator.pairing — na ciche podniesienie swojego statusu.

W praktyce atakujący mógł wysłać żądanie parowania, które wyglądało na niegroźne, ale żądało statusu operator.admin. Z powodu systemowej awarii w sposobie, w jaki aplikacja walidowała te żądania, podniesienie uprawnień odbywało się bez żadnej wtórnej weryfikacji. Co ciekawe, poza początkowym uściskiem dłoni (handshake) nie była wymagana żadna interakcja użytkownika. Z perspektywy użytkownika końcowego wszystko wyglądało normalnie, podczas gdy atakującemu w zasadzie przekazano główne klucze do królestwa.

Spędziłem lata na analizowaniu złożonych ataków APT i ten konkretny exploit przypomina mi klasyczną logikę „zepsutej windy”: naciskasz przycisk lobby, ale system pozwala Ci ominąć czytnik identyfikatorów bezpieczeństwa, aby dotrzeć do penthouse'u. W świecie agentów AI penthouse zawiera Twoje krytyczne dane, prywatne wiadomości i zapisane poświadczenia.

Ocena powierzchni ataku

Z perspektywy ryzyka nie da się przecenić wpływu tej podatności. Kiedy mówimy o eskalacji uprawnień, często myślimy o niej jako o pojedynczym kroku w długim łańcuchu. Tutaj eskalacja jest łańcuchem. Gdy atakujący uzyska dostęp administracyjny do instancji OpenClaw, nie znajduje się tylko w piaskownicy; operuje z pełnymi uprawnieniami użytkownika hosta.

Dla środowiska korporacyjnego jest to cyfrowy odpowiednik wycieku ropy. Szkody nie ograniczają się do początkowego punktu uderzenia. Atakujący z uprawnieniami administratora może odczytywać połączone źródła danych, eksfiltrować poświadczenia przechowywane w środowisku umiejętności agenta i przechodzić do innych połączonych usług, takich jak Jira czy AWS. Ponieważ OpenClaw został zaprojektowany jako solidny asystent, często posiada „klucze” do różnych interfejsów API już zapisane w swojej pamięci.

Ostatecznie podatność ta pozwalała na pełne przejęcie instancji. Tysiące instancji mogło zostać skompromitowanych w ciągu ostatniego miesiąca, a ponieważ exploit był tak dyskretny, wielu użytkowników może nadal nie zdawać sobie sprawy, że ich cyfrowy surogat dorabiał na boku dla kogoś innego.

Bramkarz w klubie VIP: Dlaczego Zero Trust ma znaczenie

Ten incydent służy jako idealna lekcja tego, dlaczego musimy traktować agentów AI ze zdrową dawką paranoi. Często postrzegamy te narzędzia jako pomocnych towarzyszy, ale w kontekście bezpieczeństwa reprezentują one ogromne rozszerzenie powierzchni ataku. Powinniśmy myśleć o modelu zero trust jak o bramkarzu w klubie VIP przy każdych wewnętrznych drzwiach naszego systemu operacyjnego. To, że wpuściłeś AI do klubu, nie oznacza, że powinno ono mieć dostęp do zaplecza bez stałej, szczegółowej re-weryfikacji jego poświadczeń.

Twórcy OpenClaw wydali poprawkę, ale pomijając samo łatowanie, fundamentalny problem pozostaje: przyznajemy autonomicznym agentom większą władzę, niż nasze obecne ramy bezpieczeństwa są przygotowane monitorować. W kontekście regulacyjnym rodzi to istotne pytania o integralność danych i nieautoryzowany dostęp. Jeśli agent AI wykona złośliwe działanie w Twoim imieniu, ponieważ został skompromitowany, kto ponosi odpowiedzialność?

W stronę odpornej strategii AI

Jeśli jesteś jednym z 347 000 użytkowników, którzy zintegrowali OpenClaw ze swoim przepływem pracy, Twój pierwszy krok jest oczywisty: natychmiast zaktualizuj oprogramowanie do najnowszej wersji. Jednak samo zatykanie dziur w kadłubie statku nie wystarczy, jeśli statek jest fundamentalnie zaprojektowany tak, by nabierać wody. Musimy przemyśleć, jak izolujemy tych agentów.

Mówiąc proaktywnie, organizacje powinny wdrożyć następujące kroki, aby złagodzić ryzyko związane z agentową sztuczną inteligencją:

- Audyt uprawnień: Stosuj zasadę najmniejszych uprawnień. Czy Twój agent AI naprawdę potrzebuje dostępu do Twojej głównej poczty e-mail i terminala? Jeśli nie, cofnij go.

- Izolacja środowisk: Uruchamiaj agentów AI w kontenerach lub maszynach wirtualnych, które nie mają bezpośredniego dostępu do głównego systemu plików ani wrażliwych udziałów sieciowych.

- Monitorowanie wywołań API: Prowadź logi kryminalistyczne działań podejmowanych przez Twoich agentów AI. Jeśli agent zacznie wykonywać nietypowe wywołania narzędzi lub uzyskiwać dostęp do plików, których nie dotykał od miesięcy, jest to sygnał ostrzegawczy.

- Rotacja poświadczeń: Jeśli podejrzewasz, że instancja została skompromitowana, załóż, że wszystkie przechowywane klucze API i tokeny sesji są skażone. Natychmiast je zrotuj.

Poruszając się po tym nowym krajobrazie, musimy pamiętać, że prywatność i bezpieczeństwo to nie tylko pola do odhaczenia w audycie zgodności — to fundament zaufania w erze AI. Nie możemy pozwolić, aby nasze pragnienie automatyzacji wyprzedziło nasze zaangażowanie w solidną obronę.

Źródła:

- Blink Security Research: Analysis of OpenClaw Privilege Escalation.

- National Vulnerability Database: CVE-2026-33579 Detail.

- OpenClaw GitHub Repository: Security Advisory and Patch Notes.

Do zobaczenia po drugiej stronie.

Nasze kompleksowe, szyfrowane rozwiązanie do poczty e-mail i przechowywania danych w chmurze zapewnia najpotężniejsze środki bezpiecznej wymiany danych, zapewniając bezpieczeństwo i prywatność danych.

/ Utwórz bezpłatne konto